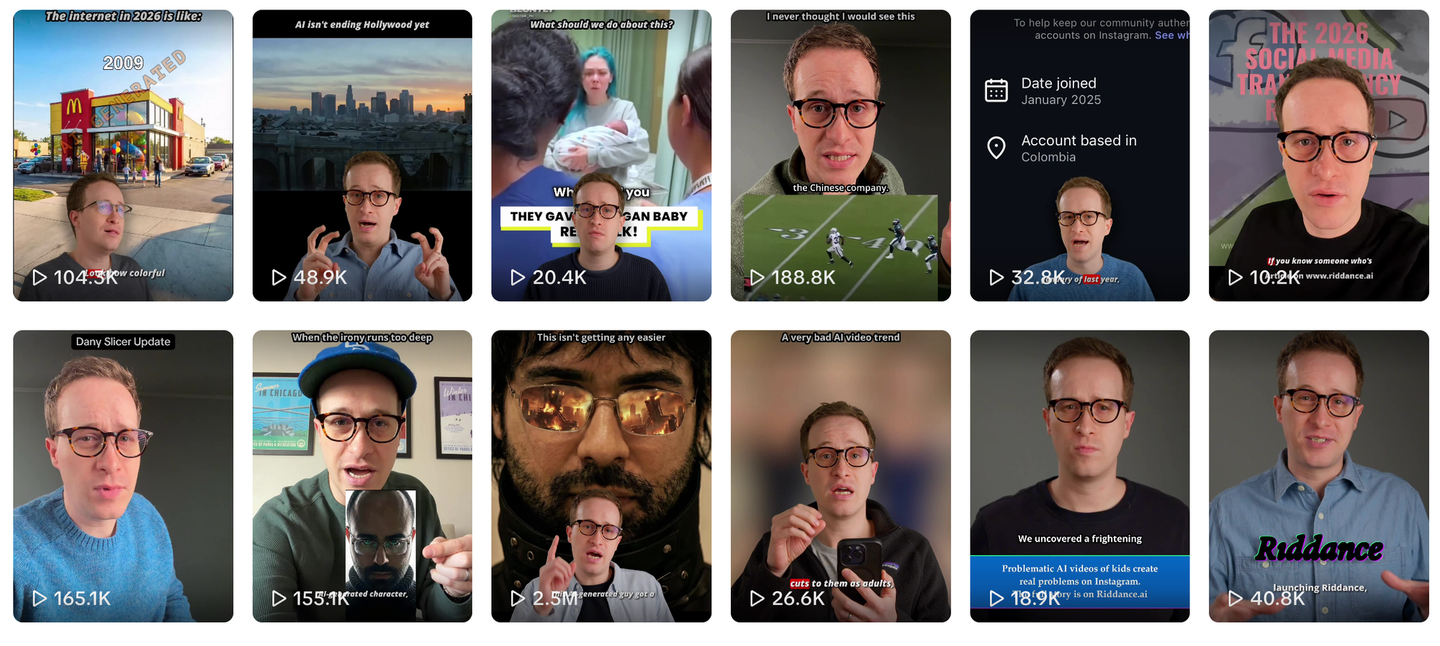

Le parcours de Jeremy Carrasco illustre parfaitement comment l'éducation citoyenne peut reprendre le terrain face à la manipulation algorithmique. Parti d'une analyse technique de Veo3 en juin dernier, il cumule aujourd'hui 333 000 abonnés et 11 millions de likes en enseignant la détection de contenus IA. Ce qui frappe, c'est l'ampleur de la demande : les gens veulent comprendre, pas subir. Son approche dépasse la technique pure pour analyser les « empreintes numériques » des comptes trompeurs — qui les crée, quand, avec quelles motivations.

"La majorité de la mésinformation vient de gens qui privilégient l'engagement au-dessus de tout le reste. Les algorithmes récompensent les choses controversées."

— Jeremy Carrasco, Producteur de contenu, spécialiste détection IA

Car le vrai enjeu n'est pas de repérer les mains mal dessinées, mais de comprendre les mécanismes sociaux de la manipulation. Quand Jeremy explique que la majorité de la désinformation vient de créateurs « qui privilégient l'engagement au-dessus de tout », il pointe le cœur du problème systémique : les algorithmes récompensent la controverse, pas la vérité.

Points de vigilance

Risque de course technologique sans fin entre génération et détection. L'approche purement technique peut devenir obsolète rapidement face aux améliorations constantes des générateurs.

Et maintenant ?

- 🤘 Créer un réseau européen d'éducateurs anti-manipulation algorithmique

Fédérer les Jeremy Carrasco de chaque plateforme et pays dans une structure partagée : méthodes communes, veille technologique coordonnée, formation des formateurs. Une coalition éducateurs + chercheurs + plateformes alternatives pourrait créer des standards de littératie numérique et des certifications reconnues.

→ On saura que ça marche quand les écoles intégreront ces méthodes dans leurs cursus et que les plateformes proposeront des formations certifiées à leurs utilisateurs

- 🤘 Forcer la transparence technique par pression réglementaire coordonnée

Alliance régulateurs + associations consommateurs pour imposer l'accès en un clic aux métadonnées de tout contenu (origine, date de création du compte, outils utilisés). Jeremy montre que les données existent déjà dans les API, il faut juste contraindre leur exposition publique.

→ On saura que ça marche quand TikTok et YouTube proposeront le même niveau de transparence que Meta par contrainte légale, pas par bonne volonté

- 💪 Adopter le réflexe 'qui-quand-pourquoi' avant de partager du contenu viral

Systématiser trois questions avant tout partage : qui a publié (historique du compte), quand ça a été créé (coïncidence avec sortie d'outils IA), pourquoi maintenant (logique d'engagement vs information). Cette habitude individuelle crée un effet réseau de ralentissement de la viralité artificielle.

→ On saura que ça marche quand les contenus IA non-labellisés perdront significativement en viralité faute de relais humains réflexifs

8/10 : Score sur l'échelle des "5 piliers de la liberté", inspiré de l'ouvrage de Timothy Snyder

Ces pistes ne sont pas des recettes toutes faites, mais des points d'entrée pour repenser nos systèmes numériques selon une logique de liberté positive : non pas limiter, mais augmenter nos capacités collectives d'action.

Si tu connais des exemples réels qui vont dans ce sens — ou des contre-exemples qui méritent d'être documentés — partage-les en commentaires et discutons-en ensemble sur Discord !