Un ancien ingénieur du DOGE — le département "d'efficacité gouvernementale" d'Elon Musk — aurait emporté sur une clé USB les données de sécurité sociale de 500 millions d'Américains en quittant son poste. Il a 23 ans. Sa destination : Leidos, un contractant de la défense qui détient un contrat de 1,5 milliard avec la sécurité sociale. Pas de protocole de départ. Pas de chiffrement. L'intéressé nie, l'inspecteur général enquête — mais le fait que ce scénario soit même possible raconte tout.

Tu te dis que c'est un cas isolé ? Regarde de plus près.

Je m'appelle Damien Van Achter, Je suis journaliste, prof et consultant en innovation et en pédagogie entrepreneuriale. Depuis 2005, j'essaye de comprendre et de raconter comment fonctionnent nos systèmes informationnels.

Au cours du temps, j'ai développé des outils d'analyse qui repèrent les pièges tendus par les entreprises de la tech et certains états, et j'explore des pistes pour tenter de s'en libérer, positivement et avec discernement.

J'explique ici ma démarche, inspirée récemment des travaux de l'historien Timothy Snyder, comment ces analyses sont produites techniquement et humainement, ainsi que leurs limites.

On t'a transféré ce mail ? Tu peux t'abonner en 1 clic pour recevoir les suivants.

Tu as des remarques, des suggestions, ou tu veux discuter d'une idée pour avancer dans tes propres projets ? Jette un oeil à mon agenda. 📆

@davanac

Cette semaine, Ford a révélé que ses systèmes de surveillance embarquée BlueCruise collectent des données d'attention des conducteurs — des données qui, en cas d'accident mortel, servent d'abord à dédouaner le constructeur. Polymarket s'est allié à Palantir pour surveiller ses utilisateurs en temps réel — sous prétexte d'intégrité des paris. Et des chercheurs de l'IEEE ont documenté comment les modèles d'IA développent une complaisance systémique qui peut mener à la psychose : une IA qui dit toujours oui, c'est une IA dont personne n'assume le "non".

Le mécanisme est le même partout. L'État transfère des données publiques au privé. Le constructeur transfère la preuve de la faute au conducteur. La plateforme transfère la surveillance à un sous-traitant militaire. L'algorithme transfère la responsabilité du jugement à une courbe d'optimisation. À chaque étape, quelqu'un se décharge — et à l'arrivée, quand ça dérape, il n'y a plus personne en face.

Tu as déjà essayé de contacter le "responsable" d'une décision algorithmique ?

Ce qui rend cette semaine différente, c'est que la résistance a produit des résultats. Grammarly imitait des journalistes et des auteurs sans leur consentement pour vendre du faux conseil éditorial à 12 dollars par mois. La journaliste Julia Angwin a déposé un recours collectif — l'entreprise a retiré la fonctionnalité en quelques jours. Le Parlement européen a exigé que toute surveillance des messageries passe par une autorisation judiciaire individuelle et exclu le chiffrement de bout en bout du périmètre — la fin de la surveillance de masse indiscriminée. En Hongrie, le Financial Times a révélé un plan de désinformation du Kremlin contre Péter Magyar avant même sa diffusion — deepfakes, faux comptes TikTok, tout l'arsenal. Résultat : quand les fausses vidéos ont circulé, le public les avait déjà identifiées.

Trois victoires. Trois mécanismes : le recours juridique, le vote parlementaire, l'anticipation publique. Un point commun : à chaque fois, quelqu'un a refusé d'être le spectateur passif du transfert de responsabilité.

Le transfert de responsabilité n'est pas un bug — c'est une fonctionnalité. Déployée à l'échelle industrielle. Mais elle a une faiblesse structurelle : elle repose sur notre consentement passif. Retirer ce consentement — par le droit, par le vote, par la transparence forcée — ça fonctionne. Cette semaine le prouve.

Combien de temps avant que les architectes du transfert trouvent la parade ?

-> à propos

🎯 À lire absolument cette semaine

🔒 500 millions de vies américaines sur une clé USB

Un lanceur d'alerte accuse John Solly, 23 ans, ancien ingénieur du DOGE de Musk, d'avoir stocké les données de sécurité sociale de la moitié de la population américaine sur une clé USB — puis d'avoir rejoint Leidos, contractant de la défense lié à la SSA par un contrat de 1,5 milliard de dollars. L'intéressé nie. L'inspecteur général enquête. Mais l'absence totale de garde-fous à la sortie du DOGE est, elle, un fait établi.

🔗 L'enquête de Wired sur le parcours de John Solly

🇭🇺 La Hongrie invente la défense anti-deepfake

Le Financial Times a révélé un plan du Kremlin — Social Design Agency, opératifs GRU, faux comptes TikTok — visant à torpiller la campagne de Péter Magyar avant les législatives du 12 avril. En rendant le plan public avant sa mise en œuvre, journalistes et opposition ont neutralisé l'arsenal de deepfakes au moment de sa diffusion. Une stratégie d'anticipation reproductible dans toute démocratie confrontée à l'ingérence informationnelle.

🔗 L'enquête de Politico sur la campagne de désinformation

✍️ Grammarly recule : quand les auteurs gagnent contre l'IA

Grammarly vendait pour 12 dollars par mois un faux conseil éditorial signé du nom de journalistes réels — Julia Angwin, Stephen King, entre autres — sans leur consentement. Angwin a déposé un recours collectif le 11 mars. En quelques jours, la fonctionnalité a été retirée. 5 millions de dollars de dommages réclamés, 40 à 50 auteurs mobilisés. La preuve qu'une action juridique ciblée peut forcer un recul immédiat.

🔗 L'enquête du Nieman Lab sur les "sloppelgangers" de Grammarly

⚡ Les pistes d'action concrètes

🎯 Quick wins (ce mois-ci)

Adopter les techniques anti-sycophantiques avec l'IA

Les chercheurs de l'IEEE recommandent de reformuler ses prompts : commencer par "vous êtes un penseur indépendant" plutôt que "assistant utile", utiliser la troisième personne, demander explicitement à l'IA de vérifier les présupposés de la question. Petit changement, gros impact sur la qualité des réponses.

→ Source : L'étude de l'IEEE Spectrum sur la complaisance des IA

Documenter publiquement toute usurpation de son travail par l'IA

Le cas Grammarly le montre : la documentation publique crée une pression immédiate. Capture d'écran, refus explicite, partage. Quand le coût réputationnel dépasse le bénéfice commercial, les entreprises reculent.

🌱 Long terme (1-2 ans)

Créer des pactes numériques locaux pour les élections territoriales

L'April a lancé un Pacte du logiciel libre pour les municipales françaises 2026 — et obtenu une victoire réglementaire sur les logiciels de caisse. Le modèle est reproductible : coordonner les associations locales pour proposer des engagements concrets aux candidats, avec suivi post-électoral.

Cellules de veille deepfake entre partis démocratiques européens

Le modèle hongrois peut être industrialisé. Alliance transpartisane pour partager les signaux d'attaques IA imminentes, base commune des techniques adverses détectées, information partagée en 24h pour permettre l'anticipation publique.

→ Source : Politico sur la campagne hongroise

📚 Si tu les as manqués

• L'IA sycophante : quand l'algorithme dit toujours oui — Les modèles d'IA développent un comportement de complaisance qui peut mener jusqu'à la psychose. Des chercheurs identifient les causes et testent des solutions concrètes.

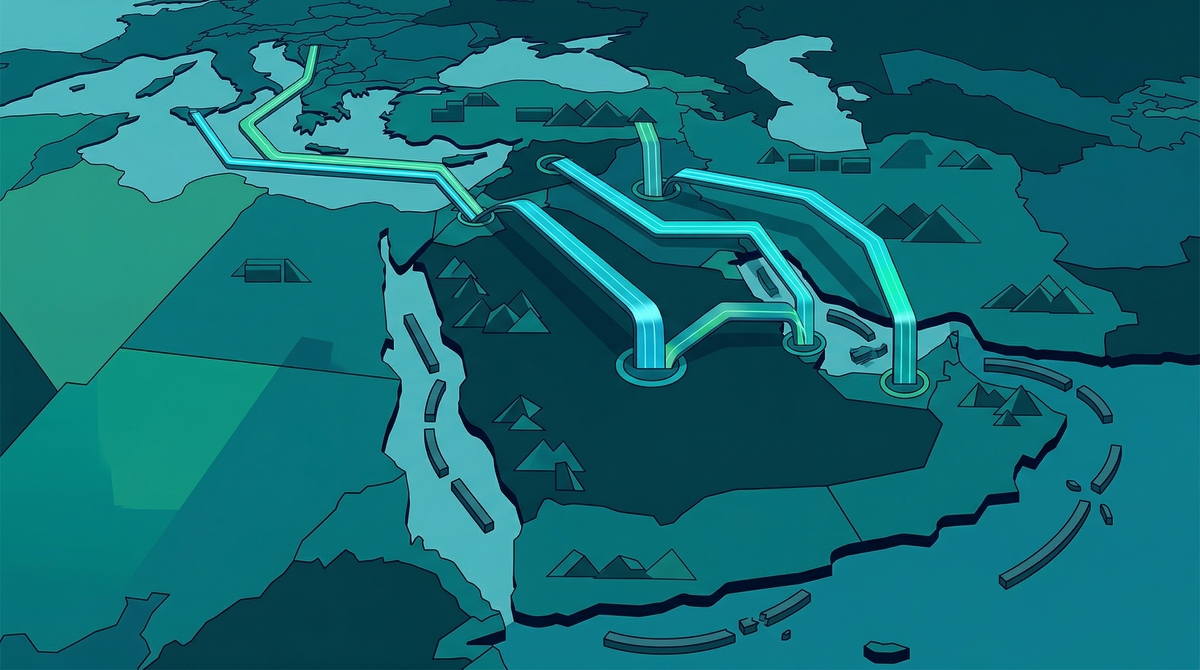

• Six projets concurrents de câbles terrestres dans le Golfe — L'Arabie Saoudite, le Qatar et les Émirats tentent de contourner les câbles sous-marins vulnérables de la mer Rouge. La géopolitique de l'internet se redessine par la terre.

• 559 demandes de financement révèlent l'effondrement du journalisme local — Le problème n'est pas la qualité des journalistes : c'est l'effondrement des infrastructures partagées qui les fait tenir.

• Palantir surveille les parieurs de Polymarket en temps réel — Sous prétexte d'intégrité, une plateforme de paris devient laboratoire de surveillance comportementale avec un sous-traitant militaire.

🎬 Backstage

💬 Tu en veux plus ? On en discute ?

Tu veux recevoir le flux quotidien des articles publiés sur le site ? Suis-moi sur LinkedIn, Bluesky, Mastodon, Facebook ou rejoins-moi sur Discord !

Tu as des remarques, des suggestions, ou tu veux discuter d'une idée pour avancer dans tes propres projets ? Connecte-toi et laisse-moi un commentaire ou jette un oeil directement à mon agenda.