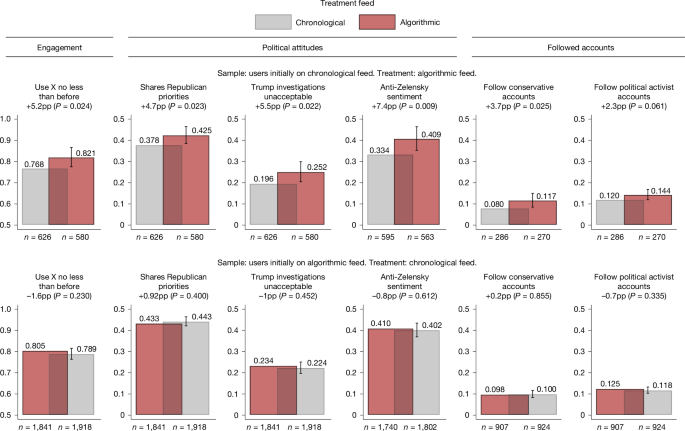

Cette recherche marque un tournant dans la compréhension des algorithmes politiques. Contrairement aux études précédentes sur Meta qui n'avaient trouvé aucun effet, cette expérience sur 4 965 utilisateurs américains de X révèle une manipulation systémique. L'algorithme ne se contente pas de montrer plus de contenu conservateur : il modifie durablement les opinions sur Trump, l'Ukraine et les priorités politiques.

"L'algorithme promeut le contenu conservateur et rétrograde les publications des médias traditionnels. L'exposition au contenu algorithmique pousse les utilisateurs à suivre des comptes d'activistes politiques conservateurs, qu'ils continuent à suivre même après avoir désactivé l'algorithme [traduit de l'anglais]"

— Équipe de recherche, Chercheurs, Université de St. Gallen et collaborateurs

Le mécanisme est vicieux : l'algorithme pousse les utilisateurs à suivre des comptes militants conservateurs, qu'ils gardent ensuite même en repassant au flux chronologique. Cette asymétrie explique pourquoi désactiver l'algorithme ne suffit pas à annuler ses effets. L'étude révèle une architecture de pouvoir où les propriétaires de plateformes peuvent sculpter l'opinion publique par le simple ordonnancement des contenus.

Points de vigilance

Cette étude porte sur la période pré-endossement de Trump par Musk (juillet 2024). Les effets pourraient être encore plus marqués aujourd'hui. Attention aussi au biais de généralisation : X n'est pas représentatif de l'ensemble des plateformes.

Et maintenant ?

- 🤘 Créer un consortium de recherche indépendant sur les algorithmes politiques

Alliance universités + journalistes d'investigation + ONG pour reproduire ce type d'études sur toutes les plateformes majeures, sans dépendre de leur coopération. Financement par fondations démocratiques européennes/américaines. Objectif : générer une pression scientifique continue et des preuves juridiquement exploitables.

→ On saura que ça marche quand les plateformes commenceront à publier des contre-études ou à modifier leurs algorithmes avant la sortie des rapports.

- 💪 Documenter ses propres changements d'opinion après usage algorithmique

Tenir un journal de ses positions politiques avant/pendant/après usage d'algorithmes de recommandation. Créer des 'groupes témoins' entre amis qui testent différents réglages. Partager les résultats sur des forums dédiés pour créer une base de données citoyenne des effets algorithmiques.

→ On saura que ça marche quand des milliers de témoignages convergents forceront les régulateurs à agir malgré les démentis des plateformes.

- ✊ Exploiter cette preuve pour des recours collectifs en manipulation électorale

Coalition avocats spécialisés + associations de consommateurs + ONG démocratiques pour attaquer X en justice sur base de cette étude. Angle : publicité mensongère (prétendre à la neutralité tout en manipulant) + ingérence électorale. Demander des dommages-intérêts pour tous les utilisateurs exposés pendant les périodes électorales.

→ On saura que ça marche quand X sera contraint de publier un warning visible sur son interface : 'Cet algorithme peut influencer vos opinions politiques'.

8/10 : Score sur l'échelle des "5 piliers de la liberté", inspiré de l'ouvrage de Timothy Snyder

Ces pistes ne sont pas des recettes toutes faites, mais des points d'entrée pour repenser nos systèmes numériques selon une logique de liberté positive : non pas limiter, mais augmenter nos capacités collectives d'action.

Si tu connais des exemples réels qui vont dans ce sens — ou des contre-exemples qui méritent d'être documentés — partage-les en commentaires et discutons-en ensemble sur Discord !