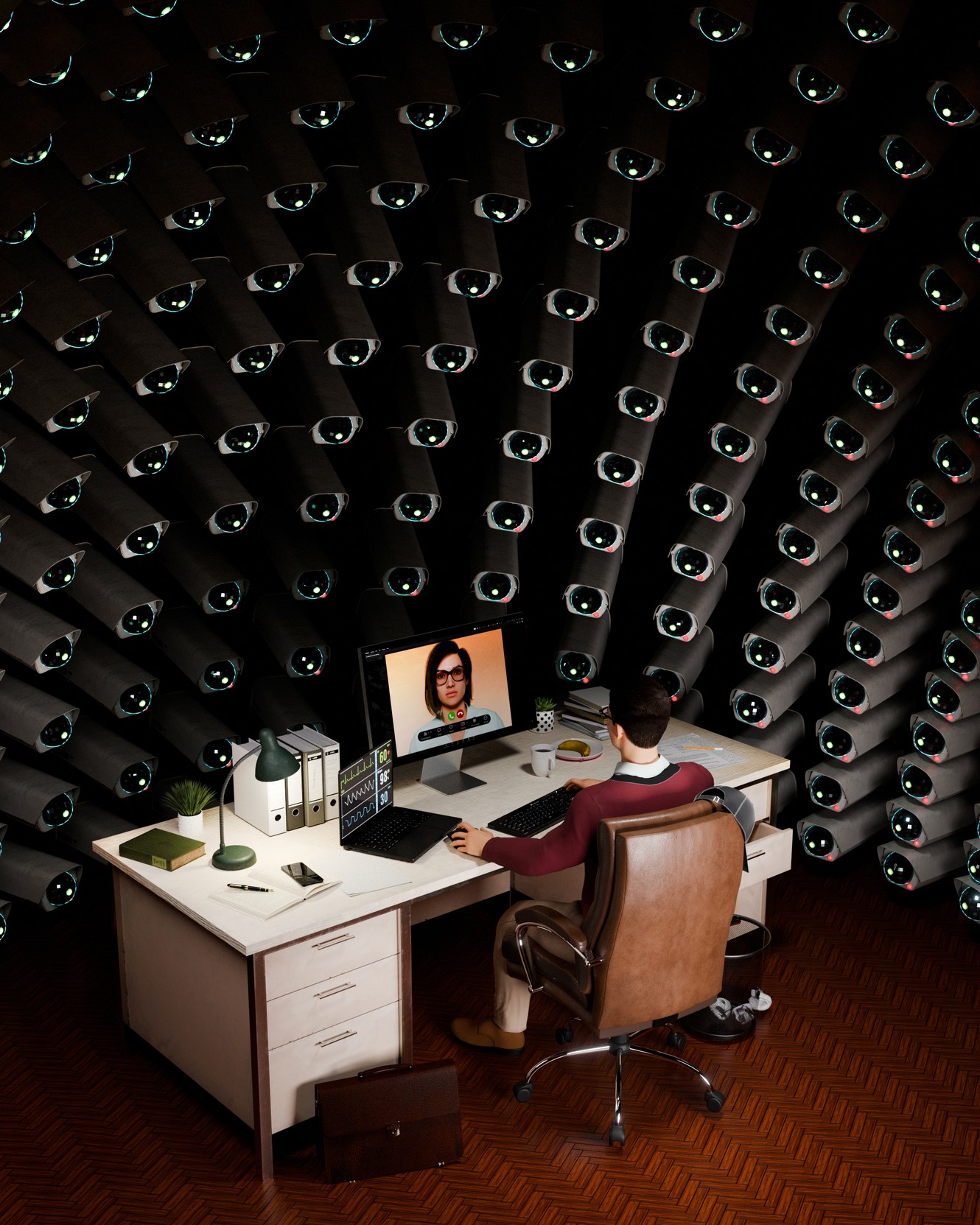

L'industrie de l'IA émotionnelle explose : le marché mondial devrait tripler d'ici 2030 pour atteindre 9 milliards de dollars. MorphCast, Aware, HireVue et des dizaines d'autres entreprises vendent aux employeurs la capacité d'analyser en temps réel les émotions de leurs salariés via caméras, micros et analyse de texte. MetLife surveille déjà la tonalité vocale de ses centres d'appels, Burger King teste un chatbot IA nommé Patty pour évaluer l'amabilité de ses employés, et Microsoft Azure permet d'analyser en masse les messages Slack pour détecter sentiment et toxicité.

"Aux États-Unis, les gens froncent les sourcils quand ils sont en colère environ 35 % du temps. Cela signifie qu'un froncement de sourcils est relativement susceptible d'être une expression de colère. Cela signifie aussi que si vous ne cherchez qu'un froncement de sourcils, vous ratez environ 65 % des cas où une personne est en colère [traduit de l'anglais]"

— Lisa Feldman Barrett, Neuroscientifique et psychologue

Cette surveillance émotionnelle suit la courbe d'adoption décrite par Cory Doctorow : elle commence par les emplois précaires (centres d'appels, transport, restauration) avant de remonter vers les cols blancs. Le problème systémique dépasse la simple question de la vie privée : ces outils créent une nouvelle forme d'aliénation où les travailleurs doivent non seulement être productifs, mais aussi performativement heureux. L'enjeu n'est plus seulement de faire son travail, mais de convaincre un algorithme qu'on l'aime.

Points de vigilance

Risque de normalisation progressive de cette surveillance émotionnelle, d'abord dans les emplois précaires puis généralisée. L'interdiction européenne pourrait créer un avantage concurrentiel déloyal pour les entreprises américaines.

Et maintenant ?

- 🤘 Créer des syndicats numériques pour négocier collectivement les limites de surveillance

Alliance syndicats traditionnels + associations de protection des données + collectifs tech pour définir des standards sectoriels de surveillance acceptable. Négocier des accords-cadres limitant l'usage d'IA émotionnelle, à l'image des négociations sur la pénibilité ou les horaires.

→ On saura que ça marche quand les premiers accords collectifs incluront des clauses spécifiques sur les limites de surveillance émotionnelle par secteur d'activité.

- 💪 Documenter et partager les pratiques de surveillance de son employeur

Créer une base de données collaborative des outils de surveillance utilisés par entreprise, à l'image de Glassdoor pour les salaires. Permettre aux candidats de connaître le niveau de surveillance avant d'accepter un poste et créer une pression concurrentielle sur les employeurs les plus intrusifs.

→ On saura que ça marche quand les entreprises commenceront à mentionner leurs pratiques de surveillance comme argument de recrutement différenciant.

- ✊ Organiser des grèves du sourire coordonnées dans les secteurs surveillés

Actions de désobéissance civile ciblées : refus collectif de jouer le jeu de la performance émotionnelle dans les centres d'appels, fast-foods et autres secteurs utilisant l'IA émotionnelle. Révéler l'absurdité du système en le saturant de 'faux positifs' volontaires.

→ On saura que ça marche quand les entreprises commenceront à désactiver leurs outils d'analyse émotionnelle face aux coûts de gestion des 'anomalies' générées.

8/10 : Score sur l'échelle des "5 piliers de la liberté", inspiré de l'ouvrage de Timothy Snyder

Ces pistes ne sont pas des recettes toutes faites, mais des points d'entrée pour repenser nos systèmes numériques selon une logique de liberté positive : non pas limiter, mais augmenter nos capacités collectives d'action.

Le règlement européen sur l'IA exclut explicitement la sécurité nationale de son périmètre. En Belgique, aucun cadre législatif ne régit aujourd'hui l'utilisation de l'intelligence artificielle par la Défense ou la Police fédérale. La pétition déposée à la Chambre demande trois choses concrètes : un inventaire des systèmes IA déjà déployés, des standards nationaux minimaux, et un positionnement parlementaire sur la surveillance de masse et les armes autonomes.

Comment agir ? La pétition nécessite 25 000 signatures, réparties entre la Flandre, la Wallonie et Bruxelles, pour déclencher un examen parlementaire. C'est un mécanisme démocratique existant — il suffit de l'activer. Signer prend moins d'une minute sur le site de la Chambre

💬 On en discute ?

Tu veux recevoir le flux quotidien des articles publiés sur le site ? Suis-moi sur LinkedIn, Bluesky, Mastodon, Facebook ou rejoins-moi sur Discord !

Tu as des remarques, des suggestions, ou tu veux discuter d'une idée pour avancer dans tes propres projets ? Connecte-toi et laisse-moi un commentaire ou jette un oeil directement à mon agenda. 📆