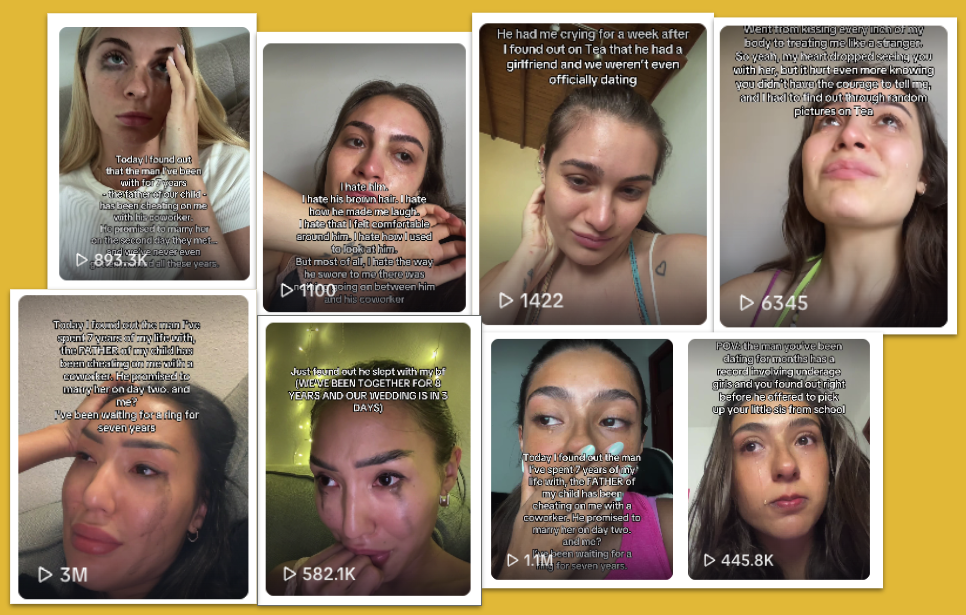

Cette enquête révèle un mécanisme d'industrialisation de la tromperie à grande échelle. Plus de 60 comptes coordonnés génèrent 2 milliards de vues en faisant passer de la publicité payée pour des témoignages spontanés d'utilisateurs. Le cas Tea illustre parfaitement cette mécanique : après une faille de sécurité majeure, l'app remonte grâce à des centaines de vidéos TikTok où une créatrice de Miami joue depuis 8 mois la femme trompée qui découvre l'infidélité de son mari. Elle annonce partir 'demain' dans chaque vidéo, mais reste avec lui dans la vraie vie.

"Les directives communautaires de TikTok exigent que le contenu soit étiqueté comme commercial quand un créateur fait la promotion d'une marque ou de ses produits ou services en échange d'un paiement [traduit de l'anglais]"

— Mahsau Cullinane, Porte-parole TikTok

Ce qui rend cette manipulation particulièrement perverse, c'est qu'elle exploite les émotions les plus intimes (trahison, rupture, humiliation) pour vendre des services numériques. Les utilisateurs prennent des décisions sur leurs données personnelles en croyant suivre des conseils de pairs, alors qu'ils consomment de la publicité déguisée. L'enquête d'Indicator documente une violation massive des règles FTC et TikTok, mais révèle surtout l'impuissance des régulateurs face à cette industrialisation de l'inauthentique.

L'enjeu systémique dépasse la simple publicité mensongère : quand l'authenticité devient un produit industriel, la capacité des citoyens à distinguer information et manipulation s'effrite. C'est toute la possibilité d'un choix éclairé qui se dissout dans un océan de faux témoignages optimisés algorithmiquement.

Points de vigilance

Risque de sur-régulation qui pénaliserait les vrais créateurs indépendants. L'identification automatisée des campagnes coordonnées pourrait créer de faux positifs sur du contenu authentique.

Et maintenant ?

- 🤘 Créer une certification collaborative de transparence publicitaire

Alliance créateurs authentiques + associations consommateurs + chercheurs pour développer un standard ouvert d'étiquetage des contenus sponsorisés. Système de notation collaborative des comptes avec API ouverte que les plateformes peuvent intégrer. Modèle : Wikipedia pour la vérification publicitaire.

→ On saura que ça marche quand les plateformes intégreront nativement les scores de transparence dans leurs algorithmes de recommandation

- 🤘 Organiser un audit citoyen massif des campagnes UGC industrielles

Mobiliser des communautés de fact-checkers bénévoles pour identifier et documenter systématiquement les réseaux de faux témoignages. Créer une base de données ouverte des patterns de manipulation avec outils d'analyse automatisée. Transformer la détection en activité collaborative gamifiée.

→ On saura que ça marche quand les annonceurs éviteront ces pratiques par peur de la détection publique systématique

- 💪 Développer son radar à contenus industriels avec des outils concrets

Apprendre à repérer les signaux techniques des campagnes coordonnées : comptes créés simultanément, variations de script identiques, géolocalisation incohérente. Utiliser des extensions navigateur qui analysent les métadonnées des profils et alertent sur les patterns suspects.

→ On saura que ça marche quand une masse critique d'utilisateurs cessera d'engager avec les contenus UGC industriels, forçant les algorithmes à les déprioriser

8/10 : Score sur l'échelle des "5 piliers de la liberté", inspiré de l'ouvrage de Timothy Snyder

Ces pistes ne sont pas des recettes toutes faites, mais des points d'entrée pour repenser nos systèmes numériques selon une logique de liberté positive : non pas limiter, mais augmenter nos capacités collectives d'action.

Si tu connais des exemples réels qui vont dans ce sens — ou des contre-exemples qui méritent d'être documentés — partage-les en commentaires et discutons-en ensemble sur Discord !