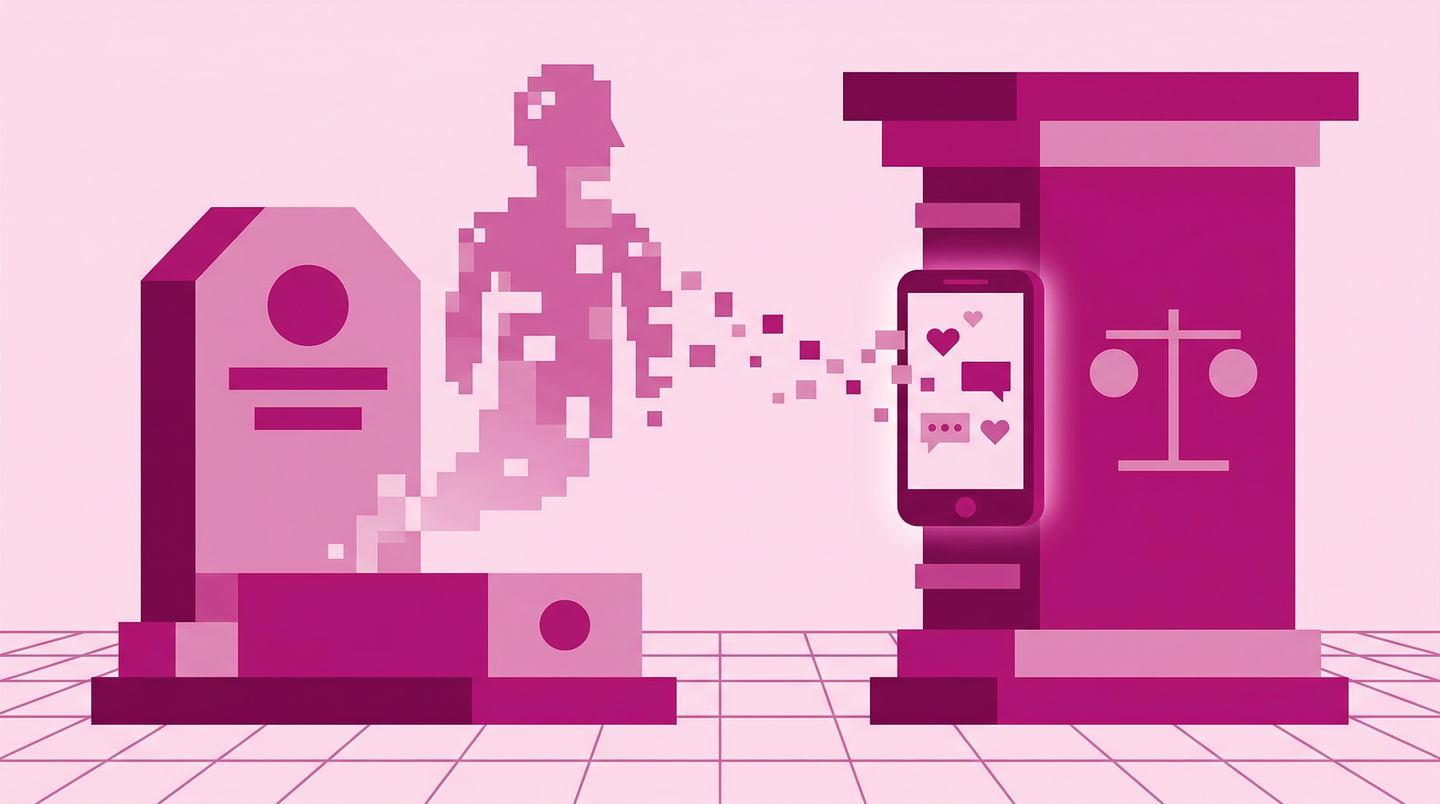

Cette analyse révèle un angle mort juridique majeur : les IA qui exploitent nos émotions les plus intimes échappent largement au droit. Les deadbots comme 2wai permettent de recréer des proches disparus, tandis que Replika et autres IA compagnons explosent en téléchargements. Le paradoxe est saisissant : le droit français protège rigoureusement le corps des défunts (interdiction des expositions commerciales de cadavres plastinés) mais laisse leur image numérique sans protection.

Les héritiers, cibles commerciales de ces outils, deviennent utilisateurs plutôt qu'opposants. L'Europe impose depuis août 2026 un marquage obligatoire des contenus IA, la Californie régule les chatbots compagnons, mais ces garde-fous restent dérisoires face aux enjeux. Car derrière la technique se cache une question existentielle : en confiant à l'IA nos émotions et relations, ne tuons-nous pas précisément ce qui fait de nous des êtres vivants et sociaux ?

Points de vigilance

Risque de normalisation de l'exploitation émotionnelle commerciale. Les régulations actuelles (marquage IA, transparence) restent cosmétiques face à l'enjeu anthropologique de fond.

Et maintenant ?

- 🤘 Créer un droit post-mortem numérique avec consentement anticipé obligatoire

Alliance juristes + associations de consommateurs + plateformes éthiques pour imposer un mécanisme de consentement anticipé (type RGPD article 85) étendu à l'image et la voix. Chaque personne définirait de son vivant l'usage autorisé de ses données biométriques après décès.

→ On saura que ça marche quand les plateformes proposeront par défaut un testament numérique lors de l'inscription

- 🤘 Développer des IA compagnons open source et non-commerciales

Coalition développeurs éthiques + psychologues + associations de santé mentale pour créer des alternatives aux IA compagnons commerciales. Modèle coopératif, données chiffrées localement, pas de monétisation des vulnérabilités émotionnelles.

→ On saura que ça marche quand des mutuelles proposeront des IA compagnons thérapeutiques non-commerciales

- 💪 Définir son testament numérique avant d'être vulnérable émotionnellement

Utiliser les outils RGPD existants (article 85) pour s'opposer dès maintenant à l'usage de ses données pour entraîner des IA post-mortem. Documenter ses volontés sur l'usage de son image et sa voix après décès, créer un précédent juridique.

→ On saura que ça marche quand les notaires intégreront systématiquement une clause numérique dans les testaments

8/10 : Score sur l'échelle des "5 piliers de la liberté", inspiré de l'ouvrage de Timothy Snyder

Ces pistes ne sont pas des recettes toutes faites, mais des points d'entrée pour repenser nos systèmes numériques selon une logique de liberté positive : non pas limiter, mais augmenter nos capacités collectives d'action.

💬 On en discute ?

Tu veux recevoir le flux quotidien des articles publiés sur le site ? Suis-moi sur LinkedIn, Bluesky, Mastodon, Facebook ou rejoins-moi sur Discord !

Tu as des remarques, des suggestions, ou tu veux discuter d'une idée pour avancer dans tes propres projets ? Connecte-toi et laisse-moi un commentaire ou jette un oeil directement à mon agenda. 📆