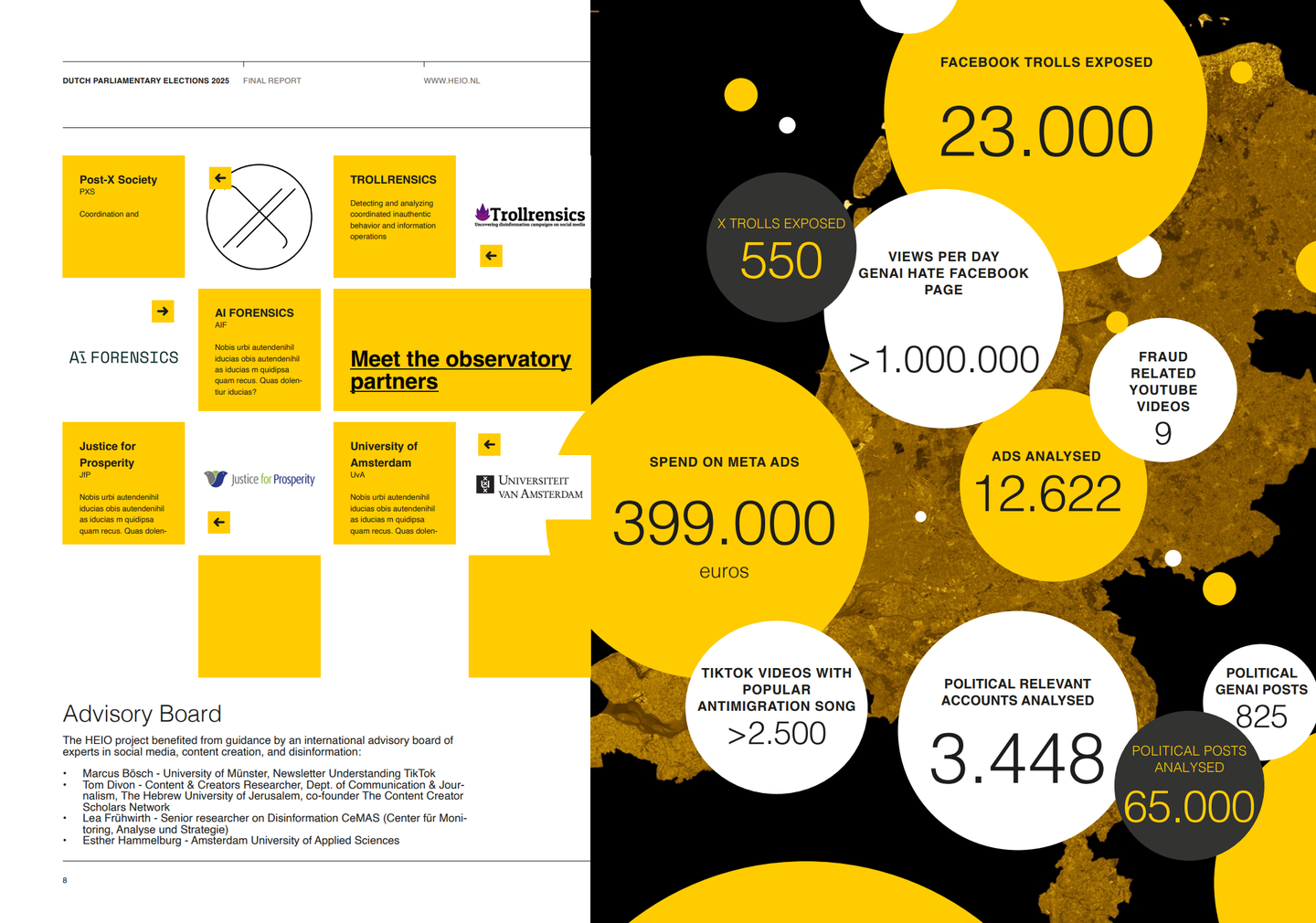

Cette enquête sur les élections néerlandaises d'octobre 2025 dévoile une nouvelle génération de manipulation électorale alimentée par l'IA. AI Forensics, intégré dans l'Observatoire d'intégrité électorale hybride, a documenté une industrialisation de la désinformation : chanson anti-immigration générée par IA atteignant le Top 50 néerlandais, imagerie violente ciblant politiciens et minorités, réseaux d'extrême droite coordonnés à travers les frontières européennes sur X.

Ce qui frappe, c'est l'échec en cascade des garde-fous : Meta et Google ont préféré bannir toute publicité politique plutôt que d'appliquer leurs règles de transparence, tandis qu'aucun contenu signalé officiellement n'a été supprimé, même en violation flagrante des politiques des plateformes.

L'étude révèle aussi les limites structurelles du Digital Services Act européen, avec des pouvoirs d'application insuffisants et des délais de réponse inadaptés à la vitesse des campagnes. On assiste à une asymétrie croissante : les manipulateurs exploitent l'IA pour industrialiser la désinformation pendant que les régulateurs restent englués dans des procédures d'un autre âge.

Points de vigilance : Risque de focalisation sur les symptômes techniques plutôt que sur les causes structurelles de la manipulation. La coopération transfrontalière nécessaire peut se heurter aux souverainetés nationales.

8/10 : Score sur l'échelle des "5 piliers de la liberté", inspiré de l'ouvrage de Timothy Snyder

Et maintenant ?

🤘 Créer un observatoire européen permanent d'intégrité électorale avec pouvoir d'enquête

Institutionnaliser le modèle de l'Observatoire hybride au niveau européen, avec mandat d'investigation transfrontalière, accès privilégié aux données des plateformes, et publication d'alertes en temps réel. Coalition société civile + autorités électorales + chercheurs universitaires pour contrer l'asymétrie informationnelle face aux manipulateurs.

→ On saura que ça marche quand les plateformes devront justifier publiquement leurs décisions de modération devant l'observatoire dans les 48h suivant un signalement.

✊ Imposer la traçabilité obligatoire des contenus générés par IA en période électorale

Obligation légale de marquage indélébile pour tout contenu IA (texte, image, audio, vidéo) publié sur les plateformes 90 jours avant une élection. Non-compliance = amende proportionnelle au chiffre d'affaires. Coalition régulateurs + médias + fact-checkers pour créer un standard technique uniforme.

→ On saura que ça marche quand les électeurs pourront identifier automatiquement les contenus IA via des outils de vérification intégrés aux navigateurs et réseaux sociaux.

💪 Développer des outils de vérification citoyenne des contenus électoraux IA

Applications permettant aux citoyens de scanner et vérifier l'authenticité des contenus électoraux en temps réel, avec base de données collaborative des manipulations identifiées. Effet démultiplicateur : chaque utilisateur devient un nœud de fact-checking distribué.

→ On saura que ça marche quand les manipulations électorales seront détectées et dénoncées par les citoyens plus rapidement que par les plateformes officielles.

Ces pistes ne sont pas des recettes toutes faites, mais des points d'entrée pour repenser nos systèmes numériques selon une logique de liberté positive : non pas limiter, mais augmenter nos capacités collectives d'action.

Si tu connais des exemples réels qui vont dans ce sens — ou des contre-exemples qui méritent d'être documentés — partage-les en commentaires et discutons-en ensemble sur Discord !

Cinq piliers pour prendre soin de nos libertés numériques