🎧 Version audio

Écoutez cet article lu par Damien Van Achter

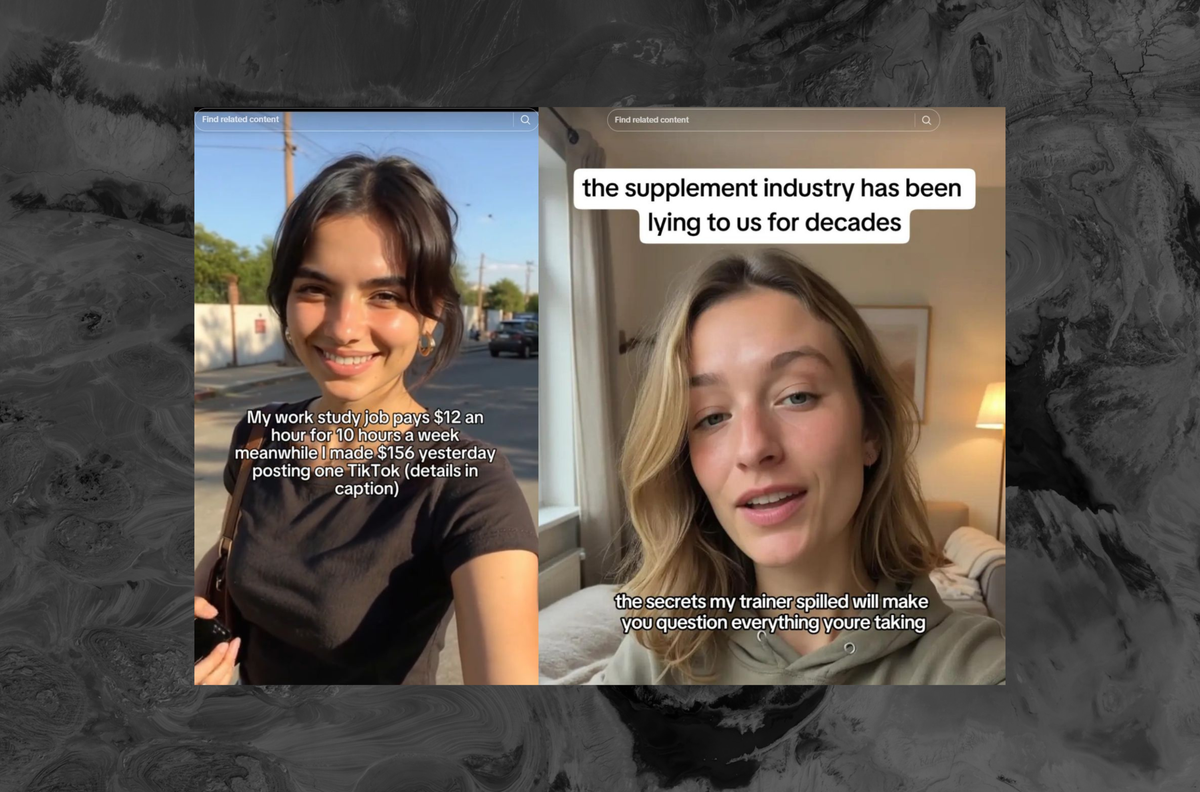

Cette affaire révèle un écosystème inquiétant où la manipulation informationnelle devient industrielle. Doublespeed, financée par le prestigieux fonds a16z, exploite des centaines de smartphones pour alimenter des comptes d'influenceurs entièrement générés par IA. Ces avatars numériques font la promotion de produits sans jamais révéler leur nature artificielle ni leur fonction publicitaire, violant les règles de transparence les plus élémentaires.

Le hack expose une infrastructure impressionnante : plus de 1000 téléphones orchestrés depuis un backend centralisé, créant une illusion de diversité et d'authenticité à grande échelle. Cette révélation soulève des questions majeures sur la véracité des contenus que nous consommons et sur notre capacité collective à distinguer l'authentique du manufacturé.

Ce qui frappe, c'est l'ambition systémique : il ne s'agit pas d'une startup bricolée mais d'une infrastructure professionnelle, financée par l'un des fonds les plus influents de la Silicon Valley. Cela suggère que cette pratique pourrait se généraliser, transformant progressivement l'écosystème des réseaux sociaux en théâtre d'influences artificielles.

Points de vigilance : Piège du « c'est juste du marketing » : cette industrialisation de la fausse authenticité érode notre capacité collective à évaluer la crédibilité des informations. Risque de normalisation progressive de la manipulation informationnelle.

8/10 : Score sur l'échelle des "5 piliers de la liberté", inspiré de l'ouvrage de Timothy Snyder

Et maintenant ?

Face à ces enjeux, plusieurs pistes d'action systémique se dessinent.

🤘 On pourrait imaginer une coalition régulateurs-plateformes-société civile pour imposer une traçabilité technique obligatoire des contenus IA.

Au lieu de compter sur l'autodéclaration (facilement contournable), exiger des plateformes qu'elles détectent et marquent automatiquement les contenus synthétiques. Cette approche créerait un précédent : les plateformes deviendraient responsables de la véracité technique de ce qu'elles diffusent, pas seulement de sa modération.

L'effet démultiplicateur serait puissant : une fois la détection technique normalisée sur TikTok, elle s'étendrait naturellement à Instagram, YouTube, puis aux médias traditionnels. Les annonceurs eux-mêmes exigeraient cette transparence pour protéger leur réputation.

On saura que ça marche quand les plateformes commenceront à développer leurs propres outils de détection IA (court terme), et quand apparaîtront des standards industriels de marquage automatique des contenus synthétiques (moyen terme).

💪 Cette affaire révèle un problème plus profond : la concentration du pouvoir narratif.

Quand a16z finance massivement des infrastructures de manipulation informationnelle, c'est tout l'équilibre démocratique qui vacille. Une piste serait de créer des mécanismes de financement public pour des alternatives authentiques : médias citoyens vérifiés, créateurs indépendants certifiés, plateformes décentralisées.

Imaginons un fonds public européen qui finance spécifiquement des créateurs de contenu transparents sur leurs méthodes, leurs financements, leur identité réelle. Ces créateurs deviendraient des références de qualité informationnelle, créant un cercle vertueux : plus d'audience pour l'authentique, moins de rentabilité pour l'artificiel.

On saura que ça marche quand émergera un écosystème économique viable pour les créateurs transparents (court terme), et quand le public privilégiera massivement les contenus certifiés authentiques (moyen terme).

✊ Le hack de Doublespeed montre une vulnérabilité systémique : ces fermes de téléphones sont techniquement fragiles.

On pourrait développer des outils open source de détection collaborative de ces infrastructures. Des chercheurs en sécurité, des journalistes et des citoyens pourraient identifier les patterns suspects : synchronisation temporelle, géolocalisation groupée, comportements répétitifs.

Cette approche « immune system » transformerait chaque utilisateur averti en capteur de manipulation. Plus il y aurait de fermes détectées et exposées publiquement, plus le coût réputationnel et opérationnel de ces pratiques augmenterait, jusqu'à les rendre non-rentables.

On saura que ça marche quand apparaîtront des communautés de détective numérique (court terme), et quand les coûts de dissimulation des fermes IA dépasseront leur rentabilité publicitaire (moyen terme).

Ces pistes ne sont pas des recettes toutes faites, mais des points d'entrée pour repenser nos systèmes numériques selon une logique de liberté positive : non pas limiter, mais augmenter nos capacités collectives d'action.

Si tu connais des exemples réels qui vont dans ce sens — ou des contre-exemples qui méritent d'être documentés — partage-les moi et documentons les ensemble !

Plus d'articles, par "pilier" de la Liberté, selon Snyder

✉︎ Abonnez-vous pour recevoir les prochains articles par mail