Mise à jour du 17 avril 17h45: des chercheurs ont documenté un problème plus préoccupant que le contournement du PIN. Le portrait extrait du passeport par NFC (Data Group 2) et les selfies pris pendant la vérification sont écrits sur le stockage externe de l'appareil sans chiffrement, et ne sont pas supprimés en cas d'échec ou de plantage. L'app, présentée comme respectant les plus hauts standards de confidentialité, laisse ainsi sur le téléphone des données biométriques couvertes par le RGPD — accessibles sans privilège particulier, contrairement au contournement du PIN qui nécessite un accès privilégié au stockage interne. Ce second volet concerne la version actuelle du code et pas seulement une build de développement. Il demande une réponse technique rapide de la Commission.

Le 15 avril 2026, Ursula von der Leyen et Henna Virkkunen ont annoncé à Bruxelles la mise à disposition d'une application européenne de vérification d'âge. Architecture cryptographique sérieuse, code entièrement open source, sept pays pilotes engagés, standards internationaux respectés. Le dispositif technique est bien construit. Et pourtant, il s'arrête au milieu du gué. Il protège la vie privée de celui qui vérifie son âge, sans rien changer au modèle qui rend cette vérification nécessaire. Pendant que Bruxelles livre un outil technique soigné, les plateformes gardent la main sur l'essentiel : l'algorithme, le modèle d'affaires, et la définition de ce qui est « approprié » pour un mineur.

Ce que l'app fait réellement

L'outil annoncé le 15 avril repose sur un principe cryptographique précis : la preuve à divulgation nulle de connaissance (zero-knowledge proof). Concrètement, l'utilisateur télécharge sa carte d'identité ou son passeport dans l'application. Quand une plateforme demande à vérifier qu'il a l'âge requis, l'app répond par oui ou par non — rien d'autre. Ni identité, ni date de naissance, ni nationalité ne transitent vers la plateforme.

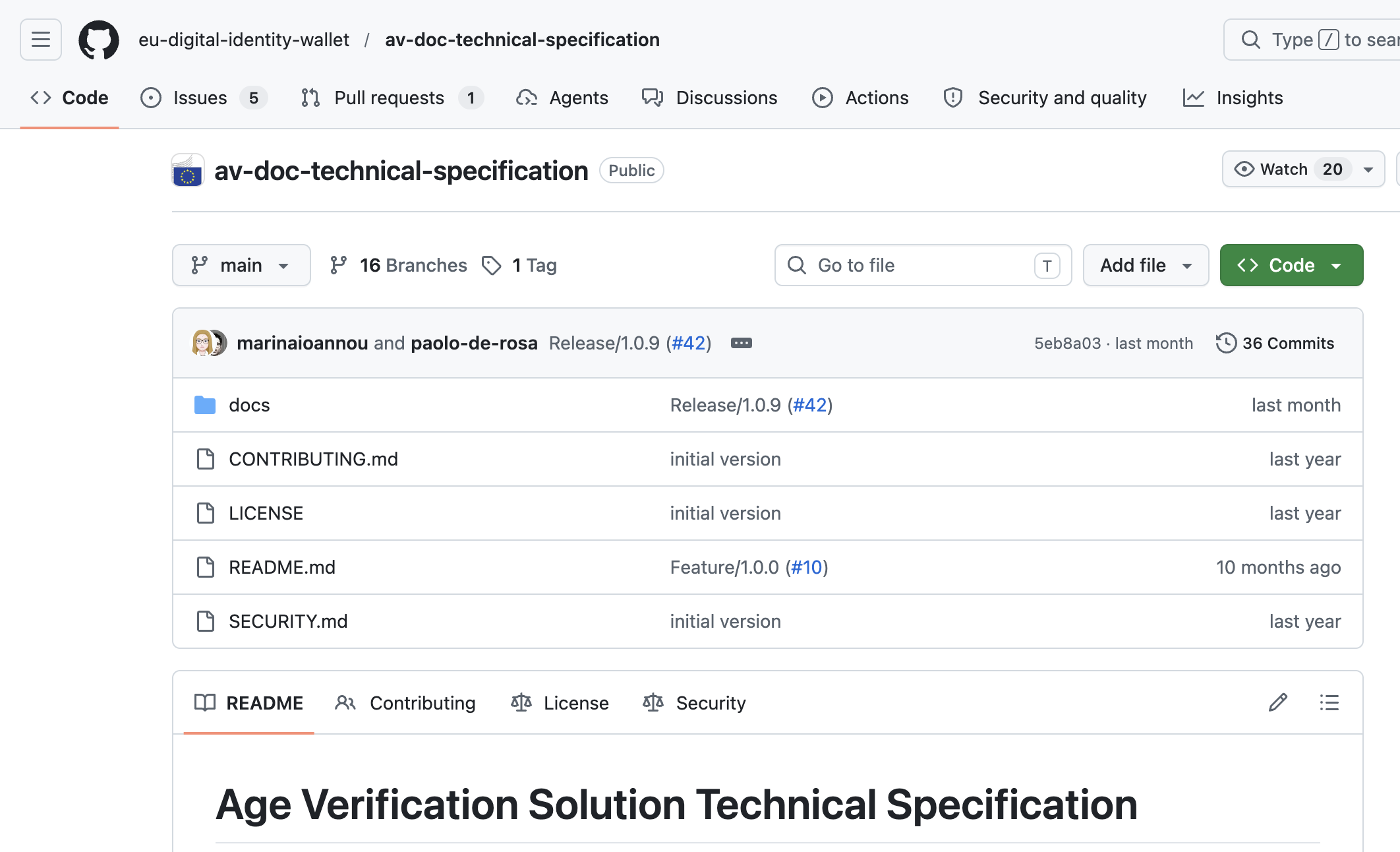

Le code est entièrement open source, déposé sur GitHub sous l'organisation eu-digital-identity-wallet. L'architecture s'appuie sur des standards ouverts : ISO/IEC 18013-5 pour le format mobile du permis de conduire, ISO/IEC 23220-2 pour les systèmes d'identité électronique génériques. La présentation passe par le protocole OpenID for Verifiable Presentations (OpenID4VP) et le format mDoc.

Sept États membres se sont engagés comme pionniers : France, Danemark, Grèce, Italie, Espagne, Chypre et Irlande. Chacun l'intégrera dans son portefeuille numérique national avant la fin 2026. L'app est un pont temporaire vers les EUDI Wallets, l'identité numérique européenne dont le déploiement complet est prévu pour la même période.

Une nuance technique s'impose : le support complet des preuves à divulgation nulle de connaissance est documenté comme « à venir » (forthcoming) dans la spécification. La version actuelle gère l'âge comme attribut, la montée en généricité cryptographique est planifiée mais pas encore livrée.

Côté plateformes, le communiqué officiel précise que « les plateformes en ligne peuvent facilement se fier à notre application ». La formulation est d'option, pas d'obligation.

Pourquoi l'architecture est un progrès

Pour saisir l'intérêt de ce choix technique, on peut le comparer aux alternatives qui circulent ailleurs.

Premier contre-modèle : le scan biométrique. Plusieurs plateformes (Yoti utilisé par Reddit, Meta via sa vérification par selfie) demandent à l'utilisateur de présenter son visage face à une caméra, un algorithme estime l'âge. Le dispositif collecte des données biométriques — non révocables, contrairement à un mot de passe — et repose sur une estimation statistique. Les chercheurs alertent depuis plusieurs années sur les biais : les personnes transgenres, âgées, ou dont l'apparence ne correspond pas aux moyennes d'entraînement sont systématiquement pénalisées.

Second contre-modèle : l'identifiant centralisé. Une plateforme demande le numéro de carte d'identité, le stocke, et chaque transaction laisse une trace liée à l'individu. C'est ce que pratique la Corée du Sud pour les jeux vidéo, ou certaines plateformes adultes aux États-Unis depuis les lois adoptées par plusieurs États. Chaque interaction devient traçable.

L'architecture européenne refuse les deux. La preuve à divulgation nulle de connaissance garantit mathématiquement que la plateforme apprend une chose — l'utilisateur a-t-il l'âge requis, oui ou non — et rien d'autre. Le code étant public, l'affirmation est auditable par n'importe quel chercheur.

Pour ceux qui voient dans cette initiative un outil de contrôle supranational, la lecture technique contredit le récit. Un dispositif de surveillance centralisée produirait exactement l'inverse : collecte maximale, code fermé, interdépendance opérationnelle forcée. L'app UE fait le chemin opposé.

Cela ne rend pas le projet parfait. Cela déplace le débat. La question pertinente n'est plus « est-ce que Bruxelles nous surveille ? » mais « est-ce que l'architecture livrée tient ses promesses, et qui contrôle ce qu'on en fait ? ».

La faille technique documentée

Moins de vingt-quatre heures après l'annonce, le 16 avril 2026, le consultant en sécurité Paul Moore a publié sur X une démonstration de contournement. La vidéo a dépassé 2,6 millions de vues.

Hacking the #EU #AgeVerification app in under 2 minutes.

— Paul Moore - Security Consultant (@Paul_Reviews) April 16, 2026

During setup, the app asks you to create a PIN. After entry, the app *encrypts* it and saves it in the shared_prefs directory.

1. It shouldn't be encrypted at all - that's a really poor design.

2. It's not… https://t.co/z39qBdclC2 pic.twitter.com/FGRvWtWzaZ

Le mécanisme qu'il documente est simple, trop simple. L'app stocke le code PIN de l'utilisateur dans un fichier local nommé eudi-wallet.xml, logé dans le dossier shared_prefs de l'application Android. Moore démontre qu'il suffit d'accéder à ce fichier, de supprimer les entrées PinEnc et PinIV, de redémarrer l'app et d'entrer un nouveau PIN : les identifiants originaux restent valides. Deux exploits supplémentaires complètent la démonstration. Le compteur de tentatives de PIN erroné est stocké comme une simple valeur numérique dans le même fichier éditable — remis à zéro, il autorise des tentatives illimitées. L'authentification biométrique est contrôlée par un booléen unique — basculé de true à false, elle est court-circuitée.

Un encadrement est nécessaire, et la plupart des reprises médiatiques l'oublient. Le fichier README du dépôt GitHub précise explicitement que le code publié est en early development, que ses standards de sécurité sont inférieurs à ceux de la version finale, et déconseille formellement l'usage en production. Moore a testé ce qui est annoncé comme non productif. La démonstration met en lumière un problème réel, elle ne teste pas la version qui sera distribuée dans les portefeuilles nationaux.

L'enseignement n'est pas « l'app est fichue » mais « l'audit public fonctionne ». 96 heures après l'annonce, la communauté de sécurité a déjà cartographié des failles. C'est ce que l'open source est censé permettre.

Le vrai test est à venir : la Commission et les États pilotes vont-ils intégrer ces retours dans la version distribuée ? Le rythme de correction sera l'indicateur de qualité du projet.

Les angles morts structurels

Les failles techniques sont corrigibles. Les angles morts structurels le sont moins.

L'obligation des plateformes reste floue. L'article 28(1) du Digital Services Act impose aux plateformes accessibles aux mineurs des mesures « appropriées et proportionnées » de protection. L'obligation est juridiquement contraignante, avec des sanctions pouvant atteindre 6 % du chiffre d'affaires mondial pour les très grandes plateformes. Mais les lignes directrices publiées par la Commission le 14 juillet 2025 se limitent à « encourager » les plateformes à adopter des méthodes de vérification en double aveugle. C'est non contraignant. Les analystes juridiques qualifient ces lignes directrices de « gold standard de facto pour la conformité » — ce qui signifie que les plateformes peuvent s'en écarter tant qu'elles fournissent un équivalent crédible. TikTok, Meta ou X pourront donc continuer à proposer leur propre dispositif. L'app européenne sera une option parmi d'autres, pas une porte d'entrée unique.

L'exclusion numérique est réelle. L'app requiert un smartphone moderne et une pièce d'identité officielle. L'organisation European Digital Rights (EDRi) souligne, dans une analyse cosignée par l'Electronic Frontier Foundation en mai 2025, que ces deux prérequis cumulés excluent mécaniquement une part de la population déjà marginalisée numériquement : personnes sans papiers, foyers sans smartphone récent, mineurs isolés. EDRi note également que plusieurs principes de minimisation des données listés dans les spécifications sont présentés comme des recommandations, pas comme des obligations contraignantes.

La collecte documentaire ne disparaît pas ailleurs. La lettre ouverte publiée en mars 2026 par 438 chercheurs en sécurité et vie privée issus de 32 pays rappelle un précédent concret : 70 000 utilisateurs de Discord ont vu leurs photos de pièces d'identité exposées après avoir fait appel d'erreurs de vérification d'âge. L'app UE, par son architecture, évite ce risque sur son propre périmètre. Si les plateformes continuent à pratiquer la collecte documentaire en parallèle — ce que le dispositif actuel autorise — la surface d'attaque globale ne diminue pas.

La charge retombe sur les parents, sans plan documenté. Le communiqué officiel présente l'app comme un outil « pour les parents, les enseignants, les responsables d'enfants ». Les modalités pratiques, elles, restent absentes de la documentation publique disponible : quel téléphone héberge l'app, comment un parent configure le profil d'un enfant, comment la délégation opère si plusieurs adultes partagent la garde. C'est un angle mort que la suite du déploiement devra combler, sous peine de faire retomber sur les familles le coût opérationnel de la politique publique.

Les contournements déjà observés ailleurs persisteront. Les adolescents continueront d'emprunter le téléphone d'un grand frère, de demander à un cousin majeur de faire la validation, d'utiliser un VPN pour accéder à des versions non-UE des plateformes. Les données australiennes (migrations vers Coverstar, Rednote, recours massifs aux VPN) montrent que les interdictions par âge ne font jamais disparaître l'usage. Elles le déplacent vers des zones moins régulées.

Ce qui manque : l'obligation des plateformes et leur statut

Le DSA n'a pas requalifié les plateformes en éditeurs. Elles restent des intermédiaires techniques, bénéficiant d'une exemption conditionnelle de responsabilité sur le contenu qu'elles hébergent (chapitre 2 du DSA, continuité avec l'ancienne directive e-commerce). Les obligations nouvelles portent sur l'évaluation des risques systémiques (articles 34 et 35) pour les très grandes plateformes, pas sur la responsabilité éditoriale du contenu amplifié.

Résultat : le design algorithmique — scroll infini, notifications push, lecture automatique, recommandations optimisées pour l'engagement émotionnel, publicité ciblée sur données comportementales — peut rester identique avant et après le déploiement de l'app. La vérification d'âge règle le ticket d'entrée. Elle ne règle pas ce qui se passe une fois à l'intérieur.

C'est là le décalage fondamental entre ce que l'app fait techniquement (vérifier une propriété) et ce qu'on lui demande politiquement (protéger les mineurs). La vérification d'âge sans refonte du design algorithmique produit des rapports de conformité plus propres, pas des niveaux de nuisance plus bas.

Le safe by design évoqué dans les textes européens reste pour l'instant une intention. Le rendre opérant supposerait de passer d'une logique d'âge (qui a le droit d'entrer) à une logique d'environnement (quelles fonctionnalités sont disponibles, par défaut, pour quels publics). Ce passage n'est pas dans l'app. Il est dans l'article 28 et dans la capacité des régulateurs nationaux à le traduire en obligations concrètes.

⚡ Les pistes d'action concrètes

L'app existe. Son code est public. Son architecture cryptographique est solide. Le dispositif est offert à dessein par Bruxelles : si la Commission a publié l'intégralité du code sur GitHub, c'est précisément pour que d'autres acteurs s'en saisissent, l'auditent, l'améliorent et construisent par-dessus. La question n'est pas de détourner l'outil contre son commanditaire, mais de prendre au mot cette ouverture. Il peut servir de socle à de nouveaux services publics numériques européens. Il peut aussi servir de base à des services privés qui respectent enfin leurs utilisateurs. Quatre pistes concrètes méritent d'être activées.

Associations enfance, bibliothèques publiques, écoles

Plutôt que de limiter l'accès des jeunes à des contenus jugés risqués, la même architecture peut ouvrir l'accès à des contenus de qualité. Les archives de presse payantes, les bases documentaires universitaires, les services culturels publics peuvent utiliser la vérification cryptographique pour offrir un accès gratuit et sans publicité aux mineurs inscrits dans une bibliothèque municipale, une école ou un dispositif éducatif. L'ancrage gouvernemental de l'identité — la preuve d'appartenance à une institution — devient le levier d'un service public numérique.

Les coalitions à activer : associations familiales, syndicats d'enseignants, réseaux de bibliothèques (l'IFLA en Europe, l'ABD en Belgique, l'ABF en France), administrations culturelles locales, éditeurs de presse qui cherchent des modèles de financement au-delà du paywall. L'argument économique est lisible : un jeune abonné via sa bibliothèque à seize ans, habitué à lire de la presse de qualité sans publicité, est un lecteur payant potentiel à vingt-cinq.

Régulateurs nationaux et société civile

L'article 28 du DSA est contraignant. Les lignes directrices européennes ne le sont pas. L'espace politique est donc national. La Belgique, la France, les États pilotes peuvent traduire l'obligation européenne en règles opposables. Cela suppose de coordonner les régulateurs (ARCOM et CNIL en France, IBPT et APD en Belgique, AGCOM en Italie, CMA au Danemark), les associations de défense des droits numériques (EDRi, La Quadrature du Net, AK Vorrat), les coalitions de parents organisés, et les fédérations de médias.

La revendication concrète est formulable en une phrase : rendre l'usage de l'app — ou d'un équivalent à même niveau cryptographique et même niveau d'audit public — obligatoire pour accéder à certaines fonctionnalités algorithmiques (publicité ciblée aux mineurs, notifications push nocturnes, recommandations sans contrôle parental, messageries ouvertes aux inconnus). Pas obligatoire pour accéder aux plateformes en général. Obligatoire pour activer les mécanismes les plus documentés comme dangereux. Le débat public gagne en précision. Les plateformes perdent en marge de manœuvre.

Fact-check et presse indépendante

Les preuves à divulgation nulle de connaissance permettent de vérifier un attribut sans révéler l'identité. L'âge aujourd'hui, mais aussi demain : statut de professionnel de la presse, adhésion à une rédaction, inscription à un ordre ou à un syndicat. Les médias indépendants et les coalitions de fact-checkers pourraient bâtir sur cette infrastructure des espaces d'accès différencié. Une salle de rédaction virtuelle où seuls les journalistes accrédités échangent, sans que leur identité personnelle soit stockée sur la plateforme hôte. Un réseau européen de vérification croisée où les contributeurs prouvent leurs qualifications sans exposer leurs données. L'app devient un outil de qualité éditoriale plutôt qu'un contrôle d'accès. Elle trie selon les compétences démontrées, pas selon la capacité à payer ou à se faire profiler.

Les acteurs à réunir existent : l'EBU, les réseaux de fact-checkers européens (EDMO, IFCN), les syndicats de journalistes, les coopératives de rédaction indépendantes. La capacité technique est là, le code aussi. La coordination, elle, reste à bâtir.

Démultiplier l'usage au-delà de l'âge

Si l'architecture cryptographique tient ses promesses pour la vérification d'âge, elle les tient pour d'autres attributs. Citoyenneté locale, résidence, statut associatif, qualification professionnelle, participation à un dispositif de soutien, droit à une prestation sociale. Chaque usage étend le domaine dans lequel la vérification remplace la collecte.

C'est là que l'app devient un coin enfoncé dans le modèle de surveillance actuel. Chaque service bâti sur la preuve à divulgation nulle de connaissance est un service qui n'a plus besoin de profiler. Le débat public gagnerait à pousser dans cette direction. Pas « l'app sert à filtrer les ados », mais « l'app est le premier élément d'une infrastructure publique qui rend la collecte de données personnelles techniquement inutile dans un nombre croissant de situations ». Le glissement est stratégique. Il fait passer la conversation d'un débat sur la restriction à un débat sur la substitution. Ce qui n'est plus collecté ne peut plus fuiter.

Organisons des Hackathons !

Reste la question du passage à l'acte. Le code est sur GitHub. Les spécifications sont publiées. Rien n'empêche des communautés techniques de se saisir de l'infrastructure pour construire des services qui n'existent pas encore. Parentage collaboratif entre familles. Contrôle parental décentralisé sans dépôt de données. Bibliothèques de lecture protégées du profilage. Messageries éducatives à accès segmenté. Espaces de délibération citoyenne à authentification différenciée.

Ces services ne viendront pas spontanément. Ils supposent d'organiser des hackathons thématiques, en lien avec les universités européennes, les associations de droits numériques, les régulateurs nationaux et les rédactions indépendantes qui ont envie de construire autre chose que la presse par abonnement.

Puisque cet article explicite un chantier concret, autant le dire clairement : je suis preneur de contributions si l'idée d'organiser un premier hackathon autour de ce protocole, à Bruxelles, à Paris, ou ailleurs.

💬 On en discute ?

Tu veux recevoir le flux quotidien des articles publiés sur le site ? Suis-moi sur LinkedIn, Bluesky, Mastodon ou Facebook !

Tu as des remarques, des suggestions, ou tu veux discuter d'une idée pour avancer dans tes propres projets ? Connecte-toi et laisse-moi un commentaire ou jette un oeil directement à mon agenda.

Je m'appelle Damien Van Achter, Je suis journaliste, prof et consultant en innovation et en pédagogie entrepreneuriale. Depuis 2005, j'essaye de comprendre et de raconter comment fonctionnent nos systèmes informationnels.

Au cours du temps, j'ai développé des outils d'analyse qui repèrent les pièges tendus par les entreprises de la tech et certains états, et j'explore des pistes pour tenter de s'en libérer, positivement et avec discernement.

J'explique ici ma démarche, inspirée récemment des travaux de l'historien Timothy Snyder, comment ces analyses sont produites techniquement et humainement, ainsi que leurs limites.

On t'a transféré ce mail ? Tu peux t'abonner en 1 clic pour recevoir les suivants.

Tu as des remarques, des suggestions, ou tu veux discuter d'une idée pour avancer dans tes propres projets ? Jette un oeil à mon agenda. 📆

@davanac

Le règlement européen sur l'IA exclut explicitement la sécurité nationale de son périmètre. En Belgique, aucun cadre législatif ne régit aujourd'hui l'utilisation de l'intelligence artificielle par la Défense ou la Police fédérale. La pétition déposée à la Chambre demande trois choses concrètes : un inventaire des systèmes IA déjà déployés, des standards nationaux minimaux, et un positionnement parlementaire sur la surveillance de masse et les armes autonomes.

Comment agir ? La pétition nécessite 25 000 signatures, réparties entre la Flandre, la Wallonie et Bruxelles, pour déclencher un examen parlementaire. C'est un mécanisme démocratique existant — il suffit de l'activer. Signer prend moins d'une minute sur le site de la Chambre