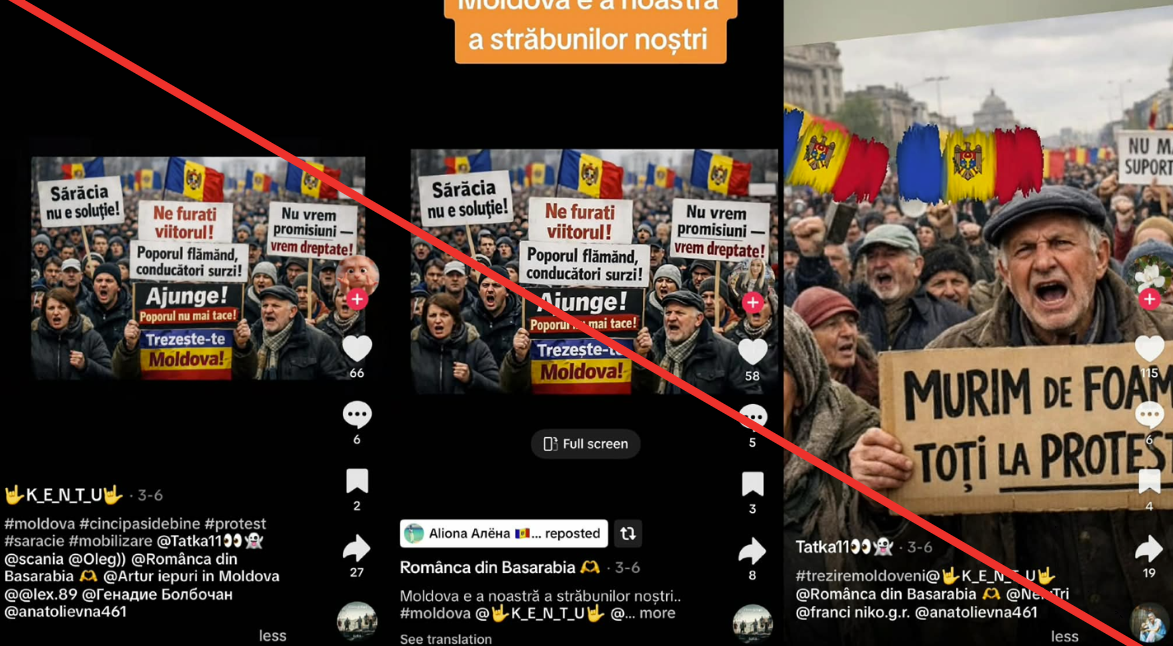

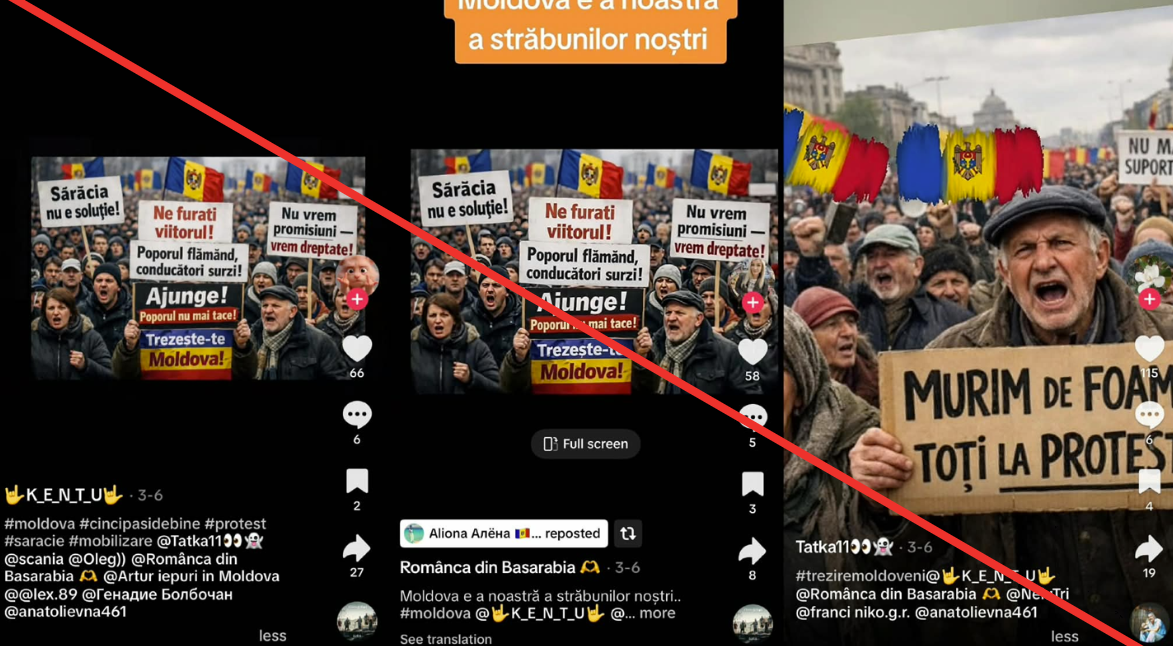

Cette opération moldave révèle une mutation inquiétante : l'IA générative ne sert plus seulement à créer de fausses informations, mais à fabriquer de fausses mobilisations. 25 comptes TikTok coordonnés ont généré 26,3 millions d'interactions en diffusant des vidéos d'IA montrant des foules en colère appelant aux manifestations du 25 mars. Le réseau combinait comptes "semeurs", amplificateurs et influenceurs locaux pour maximiser la portée.

"L'activité suggérait un positionnement antérieur au sein d'un écosystème d'influence plus large qui prônait l'alignement géopolitique de la Moldavie avec la Russie"

— Eto Buziashvili, Chercheur, DFRLab

Paradoxe révélateur : malgré cette audience massive, aucune manifestation physique n'a eu lieu. L'opération visait le parti au pouvoir PAS et la présidente pro-européenne Maia Sandu, s'inscrivant dans une stratégie plus large de déstabilisation pro-russe. Ce qui frappe, c'est la sophistication technique : contenus bilingues roumain-russe, hashtags génériques pour éviter la détection, comptes anciens pour paraître authentiques. L'échec de la mobilisation offline révèle un décalage fondamental entre viralité artificielle et adhésion réelle.

Points de vigilance

Risque de censure préventive si les plateformes sur-réagissent. Difficulté à distinguer mobilisation authentique et artificielle. Possible instrumentalisation par les gouvernements pour justifier des restrictions.

Et maintenant ?

- 🤘 Créer des observatoires citoyens de détection des campagnes coordonnées

Alliance chercheurs + journalistes + société civile pour identifier en temps réel les réseaux de désinformation. Utiliser les outils open source (Junkipedia, Exolyt) pour cartographier les patterns comportementaux suspects et alerter les autorités avant les pics de mobilisation.

→ On saura que ça marche quand les campagnes de désinformation seront exposées publiquement dans les 48h suivant leur lancement, avant qu'elles atteignent leur pic viral.

- 🤘 Développer des contre-narratifs proactifs avec les influenceurs locaux

Identifier les influenceurs authentiques dans chaque région et les former à déconstruire les faux contenus viraux. Créer un réseau de fact-checkers natifs des plateformes qui peuvent réagir rapidement avec des contenus engageants et factuels.

→ On saura que ça marche quand les débunkages d'influenceurs locaux obtiendront systématiquement plus d'engagement que les contenus de désinformation qu'ils déconstruisent.

- 💪 Apprendre à identifier les signaux de coordination artificielle

Former les citoyens à repérer les indices de manipulation : comptes avec photos identiques, hashtags génériques répétés, pics d'activité synchronisés. Développer des réflexes de vérification avant partage, notamment sur les appels à manifestation non officiels.

→ On saura que ça marche quand les campagnes de désinformation perdront leur viralité organique faute de relais citoyens non-avertis.

8/10 : Score sur l'échelle des "5 piliers de la liberté", inspiré de l'ouvrage de Timothy Snyder

Ces pistes ne sont pas des recettes toutes faites, mais des points d'entrée pour repenser nos systèmes numériques selon une logique de liberté positive : non pas limiter, mais augmenter nos capacités collectives d'action.

💬 On en discute ?

Tu veux recevoir le flux quotidien des articles publiés sur le site ? Suis-moi sur LinkedIn, Bluesky, Mastodon, Facebook ou rejoins-moi sur Discord !

Tu as des remarques, des suggestions, ou tu veux discuter d'une idée pour avancer dans tes propres projets ? Connecte-toi et laisse-moi un commentaire ou jette un oeil directement à mon agenda. 📆