Tu as dû t'en rendre compte, j'ai fais pas mal de tests ces 10 derniers jours 😅

Le développement et la mise en production d'un script basé sur les 5 piliers de la Liberté m'a permis de faire passer ma veille à un niveau vraiment très qualitatif.

Le résultat, et à toi de me dire maintenant ce que tu en penses, c'est la newsletter que tu reçois aujourd'hui (désolé si je t'ai ennuyé, j'en resterai désormais à 1/semaine, c'est promis). Si tu souhaites être alimenté en continu (2-3 fois par jour), je te propose de me rejoindre sur Discord, ou sur Spotify pour une version audio de chaque article, avec ma voix synthétisée 😛

Tant que j'y étais, j'ai profité de cette fin d'année pour fêter dignement l'arrivée de 2026 et ma 20ème année de présence en ligne en offrant à mon site un joyeux lifting de son code html .🎉🥳

En te souhaitant d'ores et déjà une merveilleuse année, pleine de rencontres, d'expériences et de résilience

Bonne lecture !

Damien

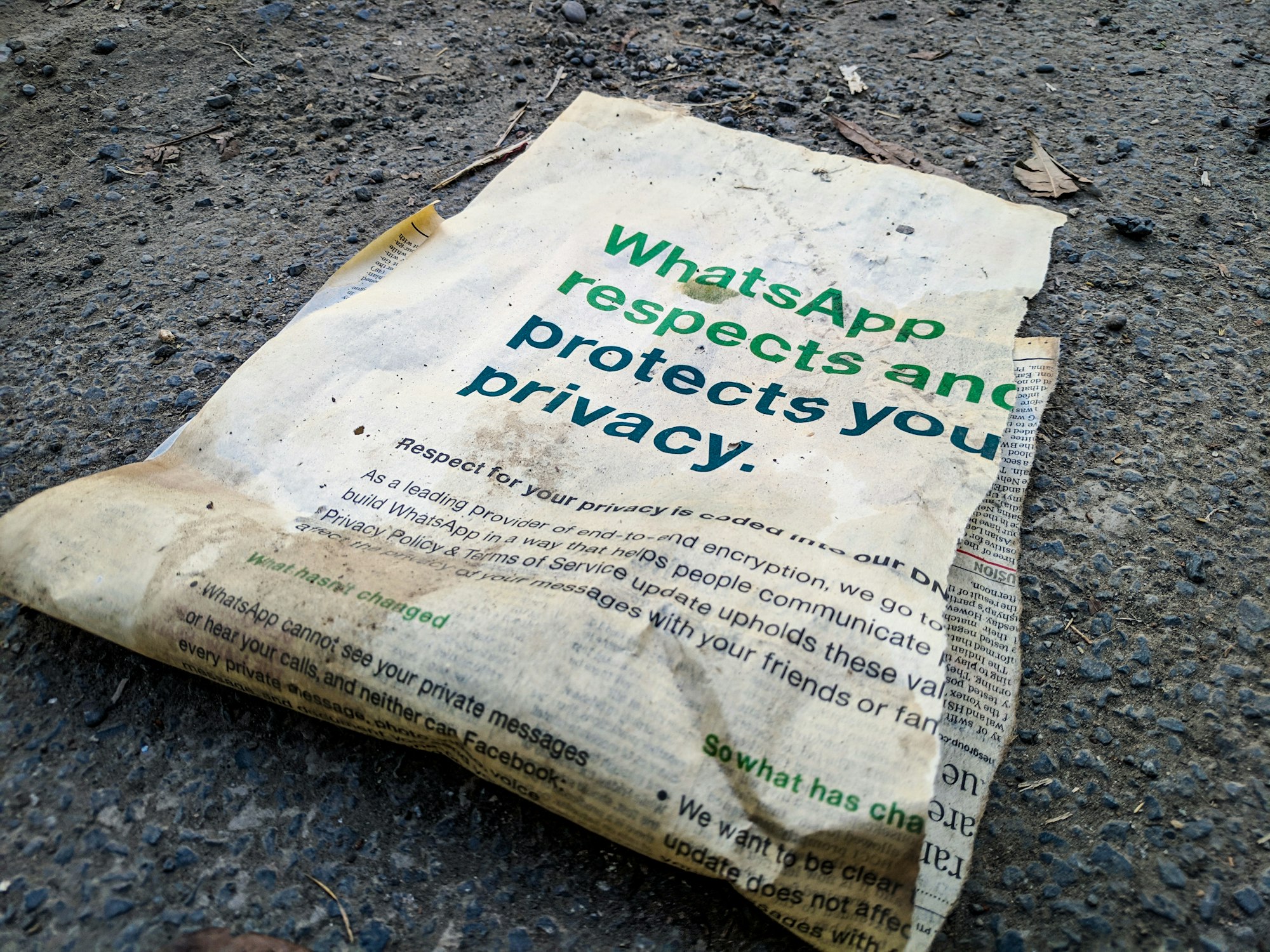

Cette dystopie n'est plus de la science-fiction. Plusieurs juridictions criminalisent désormais l'effacement de données personnelles, transformant nos réflexes de protection en preuves contre nous.

Le mécanisme est pervers : l'État présume que qui efface ses données cache forcément quelque chose d'illégal. Cette logique inverse la charge de la preuve et criminalise la vie privée elle-même.

Pendant ce temps, ICE sous-traite la traque d'immigrés à des IA 'chasseurs de primes', Trump place des artisans du Digital Services Act (DSA) sur liste noire, l'EFF révèle l'ampleur catastrophique des fuites de données en 2024, et l'Australie découvre que bannir les réseaux sociaux pousse les ados vers des contournements créatifs. Chaque semaine apporte son lot de preuves que nos données sont devenues un champ de bataille.

D'un côté, des États qui veulent tout voir et criminalisent l'opacité. De l'autre, des citoyens qui tentent de préserver ce qui reste de leur intimité numérique. Cette tension révèle une question fondamentale : dans un monde où tout est tracé, le droit à l'effacement est-il devenu le dernier rempart de la liberté ?

Comment navigues-tu entre protection personnelle et conformité légale ?

As-tu déjà hésité à effacer des données par peur des conséquences légales ? Comment protèges-tu ta vie privée sans enfreindre la loi ?

Je m'appelle Damien (@davanac) et j'essaye de comprendre comment fonctionnent nos systèmes informationnels.

J'ai développé des outils d'analyse qui repèrent les pièges tendus par les entreprises de la tech et certains états, et j'explore des pistes pour tenter de s'en libérer, positivement et avec discernement.

J'explique ici ma démarche, inspirée des travaux de l'historien Anthony Snyder, et comment ces analyses sont produites techniquement, ainsi que leurs limites.

On t'a transféré ce mail ? Tu peux t'y abonner en 1 clic

Je suis aussi journaliste, consultant et prof en innovation et en pédagogie entrepreneuriale. Si tu as des projets et que tu veux un avis ou des idées pour t'aider à avancer, jette un oeil à mon agenda et discutons-en.

Damien

🎯 à lire absolument cette semaine

Plusieurs juridictions transforment l'effacement de données en délit. Vider son téléphone avant un contrôle devient une obstruction à la justice. Cette criminalisation de la protection des données inverse la charge de la preuve et fait de la vie privée une présomption de culpabilité. Un tournant inquiétant qui redéfinit nos droits numériques fondamentaux.

-> Les pistes abordées dans l'article:

🤘 On pourrait imaginer une coalition entre organisations de défense des libertés civiles, associations LGBTQ+ et syndicats de journalistes pour faire reconnaître un "droit à l'effacement préventif" dans les textes.

💪 Les communautés numériques pourraient développer des "chartes d'autonomie algorithmique" : des documents contractuels qui obligent les administrateurs à consulter avant d'introduire de nouveaux outils d'IA.

✊ Il faut inverser la charge de la preuve culturelle : au lieu d'avoir à justifier pourquoi on veut protéger ses données, il faudrait justifier pourquoi on veut les exposer.

L'agence d'immigration américaine externalise la surveillance à des IA privées qui traquent les immigrés contre rémunération. Ces 'chasseurs de primes' algorithmiques analysent données personnelles et mouvements pour identifier leurs cibles. Une privatisation de la répression qui transforme la surveillance étatique en business model lucratif.

-> Les pistes abordées dans l'article:

🤘 Créer des coalitions « villes sanctuaires numériques » qui refusent activement la coopération avec ces systèmes de traque.

💪 Transformer la transparence algorithmique en levier judiciaire contre ces pratiques de surveillance.

✊ Développer des « passeports numériques solidaires » qui protègent les données relationnelles des communautés vulnérables.

L'Electronic Frontier Foundation dévoile son palmarès 2025 des pires violations de données. Milliards d'informations personnelles exposées, négligences corporatives massives, et citoyens laissés sans recours. Ce bilan catastrophique illustre l'échec systémique de la protection des données à l'ère numérique.

-> Les pistes abordées dans l'article:

🤘 On pourrait imaginer inverser la charge de la preuve en matière de collecte de données.

💪 Une alliance entre assureurs cyber-sécurité et organisations de consommateurs pourrait créer un 'label de sobriété numérique'.

✊ Les 'Breachies' de l'EFF montrent la puissance du naming and shaming créatif.

📚 si tu les as manqués

L'Australie bannit les réseaux sociaux pour les moins de 16 ans, mais les premiers retours montrent une créativité débordante des ados pour contourner les restrictions. VPN, fausses identités, plateformes alternatives : la prohibition numérique stimule l'innovation de contournement. Une leçon sur les limites de la régulation technologique par la loi.

🤘 Et si on créait un consortium international de régulateurs pour harmoniser les standards de protection des mineurs sur toutes les plateformes, y compris les plus petites ?

Quand les jeux vidéo deviennent l'école des robots — NitroGen de Nvidia transforme 1000+ jeux vidéo en terrain d'entraînement pour l'IA embodied et l'apprentissage robotique.

✊ Et si on créait des consortiums de développeurs de jeux indépendants pour des environnements d'entraînement souverains ?

Uber et Lyft importent les robotaxis chinois : qui contrôle nos rues ? — Uber et Lyft testent des robotaxis Baidu au Royaume-Uni dès 2026, questionnant notre souveraineté urbaine.

🤘 Et si on développait des "communs de mobilité urbaine" basés sur des protocoles ouverts et de l'infrastructure publique ?

Éduquer les « WhatsApp aunties » contre la désinformation IA — Un journaliste propose d'utiliser les fêtes pour éduquer nos proches aux nouveaux risques de désinformation générée par IA.

🤘 Et si on imaginait systématiser ces « ateliers familiaux » de fact-checking en créant des ressources standardisées pour les conversations de fêtes ?

🇧🇪 en Belgique

Journalistes belges : quand la fiscalité menace l'info indépendante — En Belgique, la réforme fiscale des droits d'auteur épargne les artistes mais oublie les journalistes. Une discrimination qui pourrait accélérer l'exode des professionnels de l'info dans un secteur déjà fragilisé.

💪 Et si on conditionnait les aides publiques aux médias à des critères de gouvernance démocratique et de conditions de travail ?

L'arnaque au changement de RIB vécue par Mathieu Michel révèle un paradoxe : nos défenses se concentrent sur la sophistication technique pendant que les fraudeurs exploitent la crédulité organisationnelle. L'erreur se situe encore le plus souvent entre le clavier et la chaise ...

🤘 Et si on transformait la formation cybersécurité en exercice de démocratie interne ?

⚡ et maintenant, on fait quoi ?

Teste tes défenses contre l'ingénierie sociale

Organise un exercice simple avec ton équipe ou ta famille : demande à quelqu'un de jouer le rôle d'un fraudeur et de tenter d'obtenir des informations sensibles par téléphone ou email. Observe combien de temps il faut pour contourner tes protocoles. Documente les failles découvertes et crée des phrases-types pour réagir aux demandes suspectes. Résultat attendu : tu identifiera tes vrais points faibles organisationnels, bien plus vulnérables que ton infrastructure technique.

Alors, tu l'as testé ? Ca donne quoi ? Je suis curieux d'avoir tes impressions ...

💬 Partage-moi ton retour d'expérience !

🎬 backstage

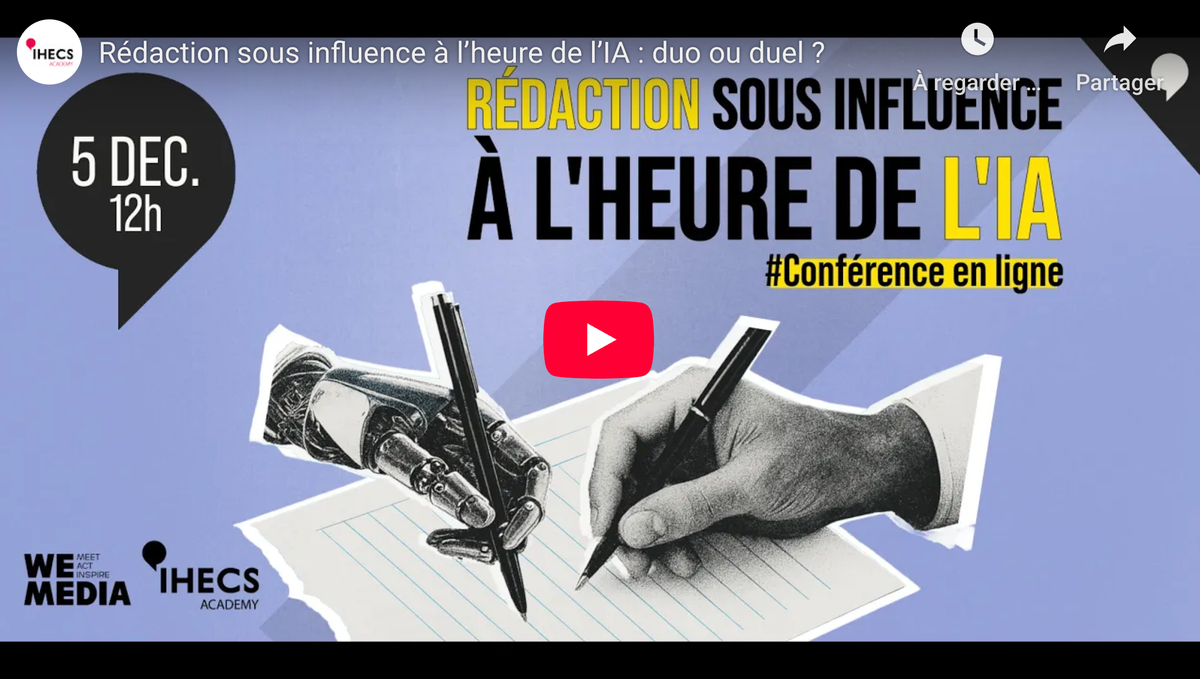

Pendant près de deux heures, nous avons exploré cette question qui obsède les rédactions : comment écrire "avec ou malgré" les machines ?

Merci à Florent Diverchy (Marketing Intelligence Manager Produpress) et Christophe Charlot (Rédacteur en chef - Gondola Media) d'avoir accepté de confronter leurs expériences et leurs doutes lors de ce webinaire organisé par IHECS Academy

Ok Mila est un projet d’éducation aux médias qui s’attaque à l’IA non pas seulement par le prisme technique, mais en questionnant ses effets très concrets sur notre manière de nous informer, de créer et de vivre ensemble.

J’ai été invité à participer au podcast pour discuter de ce que ces technologies changent dans notre rapport à l’information et à la création.

Merci à toute l’équipe d’Ok Mila pour l’invitation, et en particulier à Julie Mouvet et Cassiopée Henaff (alias Cassi Ninja) pour la qualité de nos échanges et le soin apporté à ce projet qui donne des outils concrets pour développer un regard critique sur l’IA.

💬 tu en veux plus ?

Je partage le flux quotidien des articles repérés au cours de ma veille (2-3 analyses/jour) :

→ sur Discord, en version conversation

→ sur Spotify, en version audio

Et sur LinkedIn, avec 1-2 billets par jour, au gré de mes trouvailles.

N'hésite pas à me faire part de tes remarques et suggestions (hit reply !) et/ou à la transférer à tes contacts qui se soucient de leur liberté en ligne, et hors ligne.

Cinq piliers pour prendre soin de nos libertés numériques

À dimanche prochain,

Damien