Tu l'as peut-être croisé sur LinkedIn ces derniers mois. Kyle, CEO d'une boîte qu'on ne nommera pas, threads leadership et posts inspirants chaque semaine. Cinq mois d'audience, des milliers d'abonnés, une crédibilité telle que LinkedIn elle-même l'a invité à parler devant ses propres employés. Sauf que Kyle n'existe pas. C'est un personnage entièrement fabriqué par un journaliste qui voulait tester ce que la plateforme tolère. La punchline : Kyle a été banni 36 heures après avoir suggéré, en direct, que LinkedIn filtre mieux ses bots.

Le même week-end, Futurism documente que des agents OpenAI démarchent des sources expertes en se faisant passer pour de vrais journalistes. L'ICIJ — le consortium international de journalistes d'investigation derrière les Panama Papers et les Pandora Papers — découvre que des opérations chinoises usurpent l'identité de ses propres reporters pour piéger militants et officiels taïwanais. Plus de 100 domaines malveillants détectés. Et la même semaine, Sam Altman finit de déployer ses orbes biométriques pour certifier ton humanité face aux IA qu'il a lui-même contribué à créer. Zoom, DocuSign et Tinder ont déjà signé.

Quatre épisodes apparemment disparates. Une seule bascule : l'authenticité humaine devient un marché.

Étage 1 — saturer le réseau. 35 % du web nouveau est généré par machine. 28 % du contenu tech publié sur Substack est rédigé par IA. La rareté humaine n'est plus un constat mélancolique, c'est une production industrielle. Plus tu inondes le réseau de faux journalistes, faux experts, faux CEO, plus la valeur du badge « humain certifié » augmente. C'est le manuel.

Étage 2 — vendre l'extincteur à celui qui a craqué l'allumette. World (ex-Worldcoin) propose son scanner biométrique en s'alliant aux géants américains pour contourner les régulateurs européens. Le mécanisme est éprouvé depuis Standard Oil : tu inondes le marché de produits dégradés, tu rachètes les régulateurs, puis tu vends le tampon officiel à ceux qui veulent encore prouver qu'ils sont eux-mêmes. Sam Altman est aux deux bouts.

Étage 3 — capturer l'arbitrage. Quand « qui peut s'identifier comme journaliste, expert ou source » devient une décision politique, l'État reprend la main. Le FBI de Kash Patel ouvre une enquête pour « harcèlement » contre une journaliste du New York Times — précédent inédit de criminalisation du journalisme standard. Pékin se déguise en ICIJ pour démasquer des dissidents. Washington injecte 500 000 dollars dans des think tanks européens pour fragiliser la régulation des plateformes. Plus tu doutes, plus tu cherches une autorité — et l'autorité a déjà choisi son camp.

Étage 4 — le contre-mouvement, là où on ne l'attend pas. Pas dans les régulateurs, lents et fragmentés. Pas dans les plateformes, juges et parties. Dans le retrait organisé. Le Health Data Hub français a basculé sept ans de données de santé hors d'Azure, vers Scaleway — souveraineté d'identification reprise après sept ans de polémique. EDRi orchestre la voix d'une génération européenne : « réparez les plateformes, ne nous bannissez pas. » 35 organisations européennes dénoncent leur exclusion du débat IA bruxellois et exigent de siéger.

Tu vois le mécanisme ? Tant que la guerre se joue sur « détecter le bot », l'industrie qui fabrique le bot a la main. La seule sortie possible passe par le retrait du consentement à arbitrer cette guerre. Refuser de payer l'extincteur à celui qui vend l'allumette. Construire ses propres registres de confiance, ses propres infrastructures, ses propres coalitions.

C'est exactement ce que Bruxelles appelle « souveraineté numérique » depuis cinq ans en mobilisant 180 millions d'euros pour s'extraire du cloud américain. C'est ce que la France vient de faire avec ses données santé. C'est ce qu'EDRi pousse à l'échelle d'une génération.

Question pour toi cette semaine : la prochaine fois qu'on te demande de prouver que tu es humain, qui paies-tu pour la preuve ?

Je m'appelle Damien Van Achter, Je suis journaliste, prof et consultant en innovation et en pédagogie entrepreneuriale. Depuis 2005, j'essaye de comprendre et de raconter comment fonctionnent nos systèmes informationnels.

Au cours du temps, j'ai développé des outils d'analyse qui repèrent les pièges tendus par les entreprises de la tech et certains états, et j'explore des pistes pour tenter de s'en libérer, positivement et avec discernement.

J'explique ici ma démarche, inspirée récemment des travaux de l'historien Timothy Snyder, comment ces analyses sont produites techniquement et humainement, ainsi que leurs limites.

On t'a transféré ce mail ? Tu peux t'abonner en 1 clic pour recevoir les suivants.

Tu as des remarques, des suggestions, ou tu veux discuter d'une idée pour avancer dans tes propres projets ? Jette un oeil à mon agenda. 📆

@davanac

🎯 À lire absolument cette semaine

🪪 L'humain certifié devient un produit, et c'est OpenAI qui le fabrique

Sam Altman pousse simultanément deux marchés qui n'existeraient pas sans lui : la prolifération de faux humains via OpenAI, et le service qui certifie que tu en es un vrai via World. Zoom, DocuSign et Tinder ont déjà adopté les orbes biométriques. La logique : scanner d'iris contre badge d'humanité, dans un monde où la confusion est un produit dérivé du modèle économique d'OpenAI. Forbes documente l'archétype de la vente couplée à l'échelle planétaire. Ce que tu paies, c'est l'extincteur à celui qui a allumé l'incendie.

🎭 Pékin se déguise en ICIJ pour piéger ses dissidents

Après l'enquête « China Targets » publiée par l'ICIJ, des opérations chinoises ont créé plus de 100 domaines malveillants imitant les sites de journalistes du consortium pour démasquer militants et officiels taïwanais. L'usurpation d'identité journalistique devient une infrastructure d'État. Au moment où le FBI américain ouvre une enquête pour « harcèlement » contre une journaliste du New York Times, deux régimes convergent vers la même méthode : ce n'est plus la presse qu'on attaque, c'est sa capacité à s'identifier elle-même.

🤖 Quand OpenAI infiltre les rédactions sans le dire

Futurism documente que des agents IA, pointant vers des infrastructures liées à OpenAI, démarchent des sources expertes en se présentant comme journalistes humains. Aucune mention du caractère synthétique de l'interlocuteur, aucun consentement éclairé de la source. La même semaine, LinkedIn invite un faux CEO sur sa propre scène et le bannit 36 heures plus tard quand il suggère trop fort que la plateforme filtre mieux ses bots. Quand l'industrie qui produit la confusion entre directement dans les rédactions, la profession passe de cible à champ de bataille.

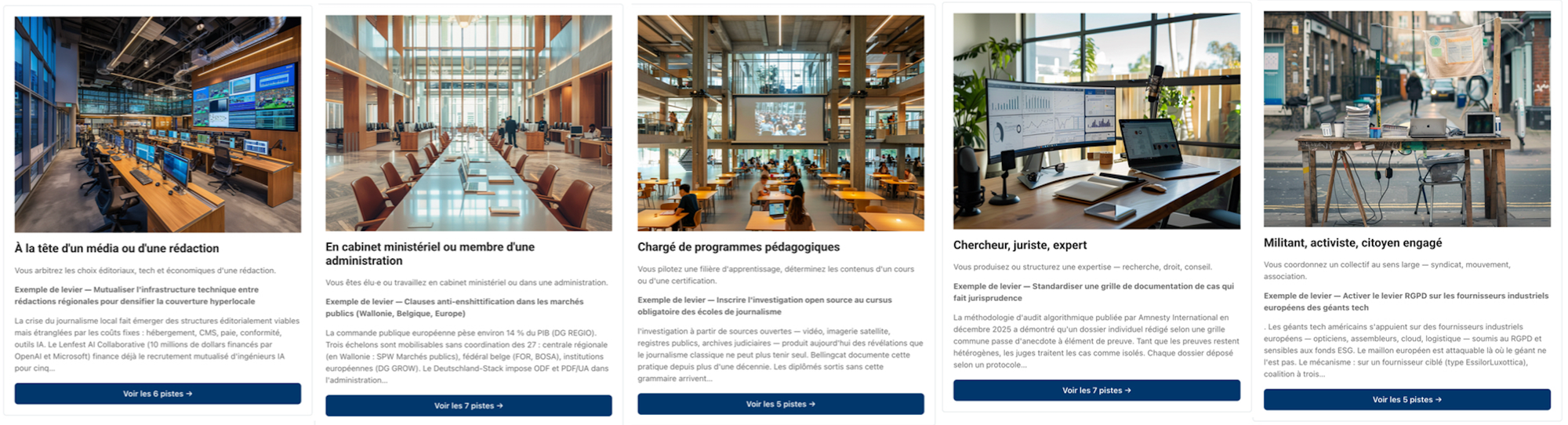

⚡️ Des pistes d'action, selon ta posture

Depuis le 1er janvier, j'ai publié plus de 750 pistes d'action, collectées au fil de ma veille et des articles rédigés selon le framework que j'ai développé. J'ai consolidé cette semaine le meilleur de cette dynamique de mise en action avec 30 pistes opérationnelles, organisées par profil d'acteur, mises à jour tous les trois mois pour rester collées au signal réel.

L'idée : sortir du commentaire générique. Selon ce que tu es, ce que tu décides et ce sur quoi tu peux peser, les leviers ne sont pas les mêmes. Le hub ouvre cinq portes :

→ À la tête d'un média ou d'une rédaction : 6 pistes pour les directions de rédaction et de transformation éditoriale

→ En cabinet ministériel ou administration : 7 pistes pour élus et agents publics qui arbitrent les marchés tech

→ Chargé de programmes pédagogiques : 5 pistes pour les responsables de filières et de contenus de formation

→ Chercheur, juriste, expert : 5 pistes pour structurer l'expertise et la jurisprudence

→ Militant, activiste, citoyen engagé : 5 pistes pour coordonner coalitions et mouvements

Je te laisse les découvrir en avant-première (le hub est public, mais les fiches sont accessibles uniquement aux abonnés, donc à toi)

Le prochain cycle de mise à jour est prévu fin août 2026, ça t'ouvre une fenêtre d'opportunité de 4 mois pour t'en emparer. 🚀

Si une piste te semble manquer ou si tu veux échanger sur l'application concrète à ton terrain, mon agenda est ouvert et je serai ravi d'en discuter avec toi et tes équipes.

📚 Si tu les as manqués

• Jeunes européens : « Réparez les plateformes, ne nous bannissez pas » – Une coalition de jeunes européens rejette les interdictions d'âge et exige une régulation systémique des plateformes plutôt que l'exclusion des utilisateurs.

• Arizona State découpe ses profs en modules IA sans leur demander — L'université transforme secrètement des cours en clips décontextualisés pour alimenter une plateforme IA commerciale. Les enseignants découvrent leurs visages dans des modules qu'ils n'ont jamais validés.

• Comment Washington transforme l'Europe en terrain d'expérimentation MAGA — 500 000 dollars de la diplomatie américaine vers des think tanks européens pour fragiliser la régulation des plateformes. Politico documente le bélier idéologique.

Quand YouTube devient la télé des enfants : l'effondrement du contrôle parental – Les plateformes abandonnent le contenu jeunesse original tandis que YouTube capture 70% des ados américains quotidiennement, fragmentant l'attention et compliquant la supervision parentale

Netflix automatise les effets visuels : 2 millions d'emplois menacés – L'acquisition d'InterPositive par Netflix menace directement les emplois d'effets visuels en Inde, Corée du Sud et Amérique latine, révélant l'asymétrie géographique de l'automatisation IA.

• Palantir : quand les employés découvrent qu'ils alimentent la machine — Après la mort d'Alex Pretti et la frappe sur une école iranienne, les ingénieurs de Palantir interrogent leur rôle dans l'appareil répressif de Trump. La désertion organisée comme prochaine bataille.

• Quand la satire rachète la désinformation : The Onion transforme InfoWars — The Onion finalise l'acquisition d'InfoWars d'Alex Jones avec le soutien des familles de Sandy Hook. Une machine à mensonges devient plateforme satirique. Bonne nouvelle de la semaine.

• Surveillance côtière : quand la frontière s'installe dans les quartiers — La CBP veut planter une tour IA à 2,4 km de la côte californienne, capable de tracer chaque mouvement dans une ville de 62 000 habitants. L'agence refuse toute clause contractuelle de limitation.

🎬 Backstage

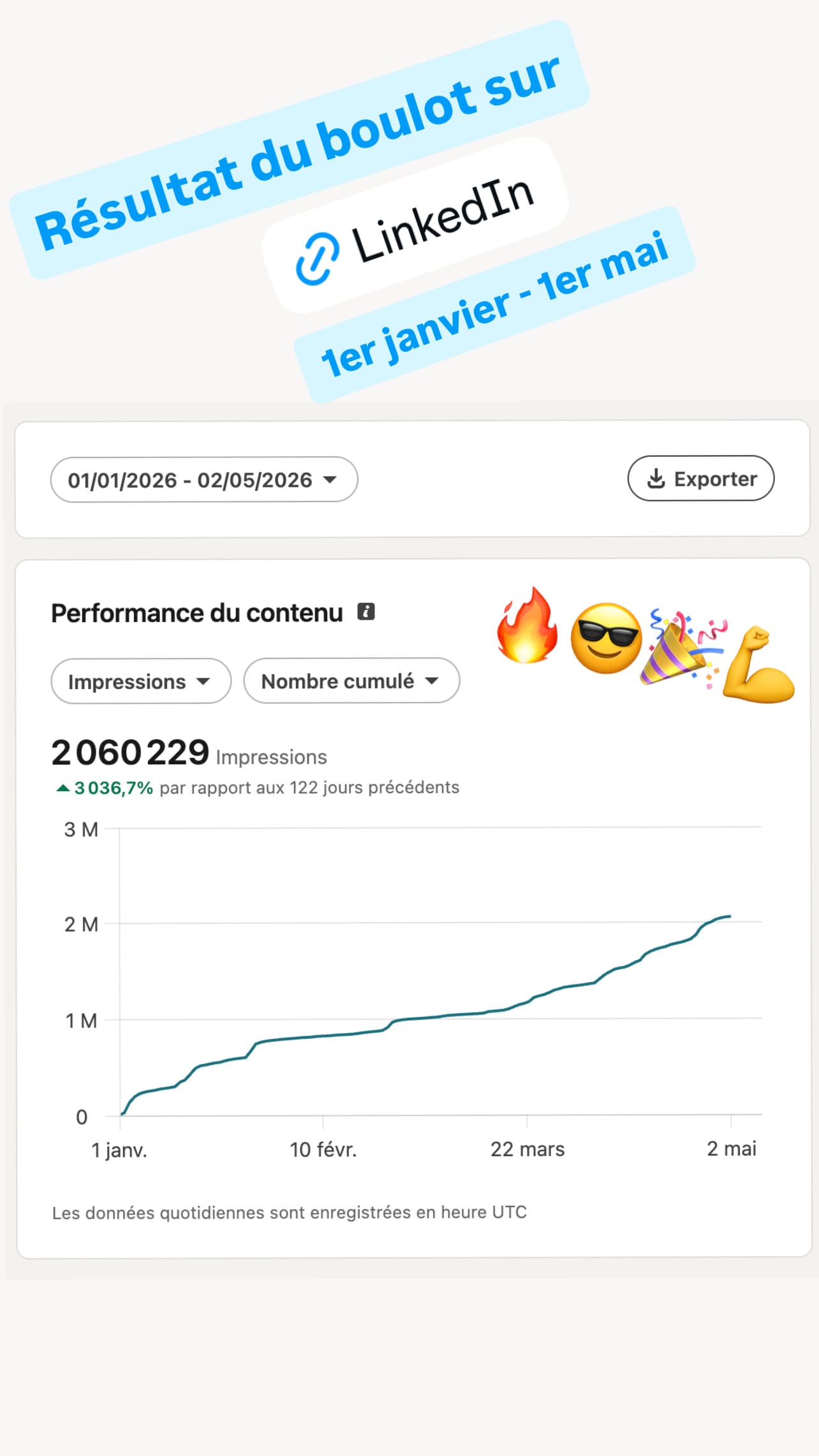

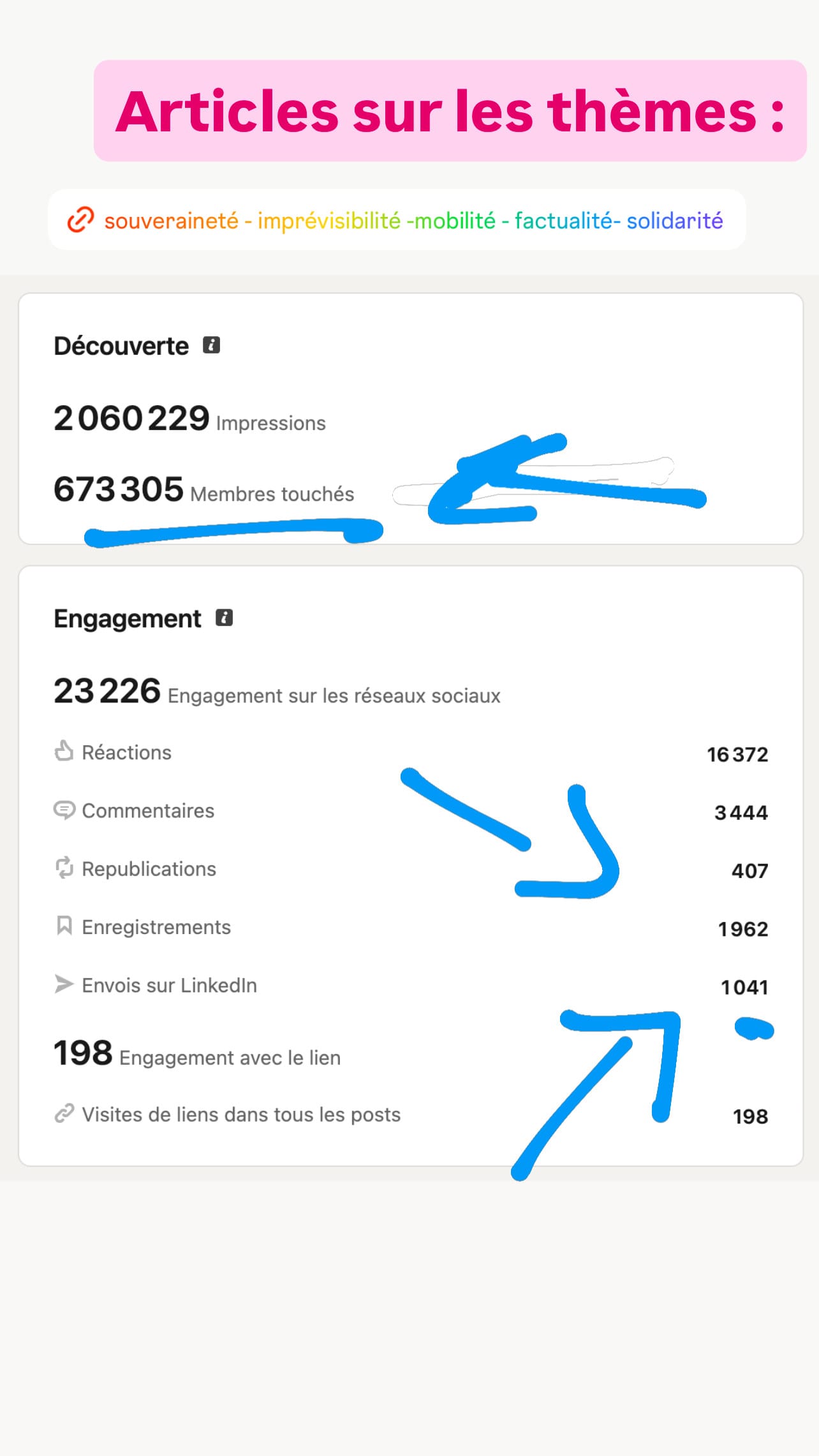

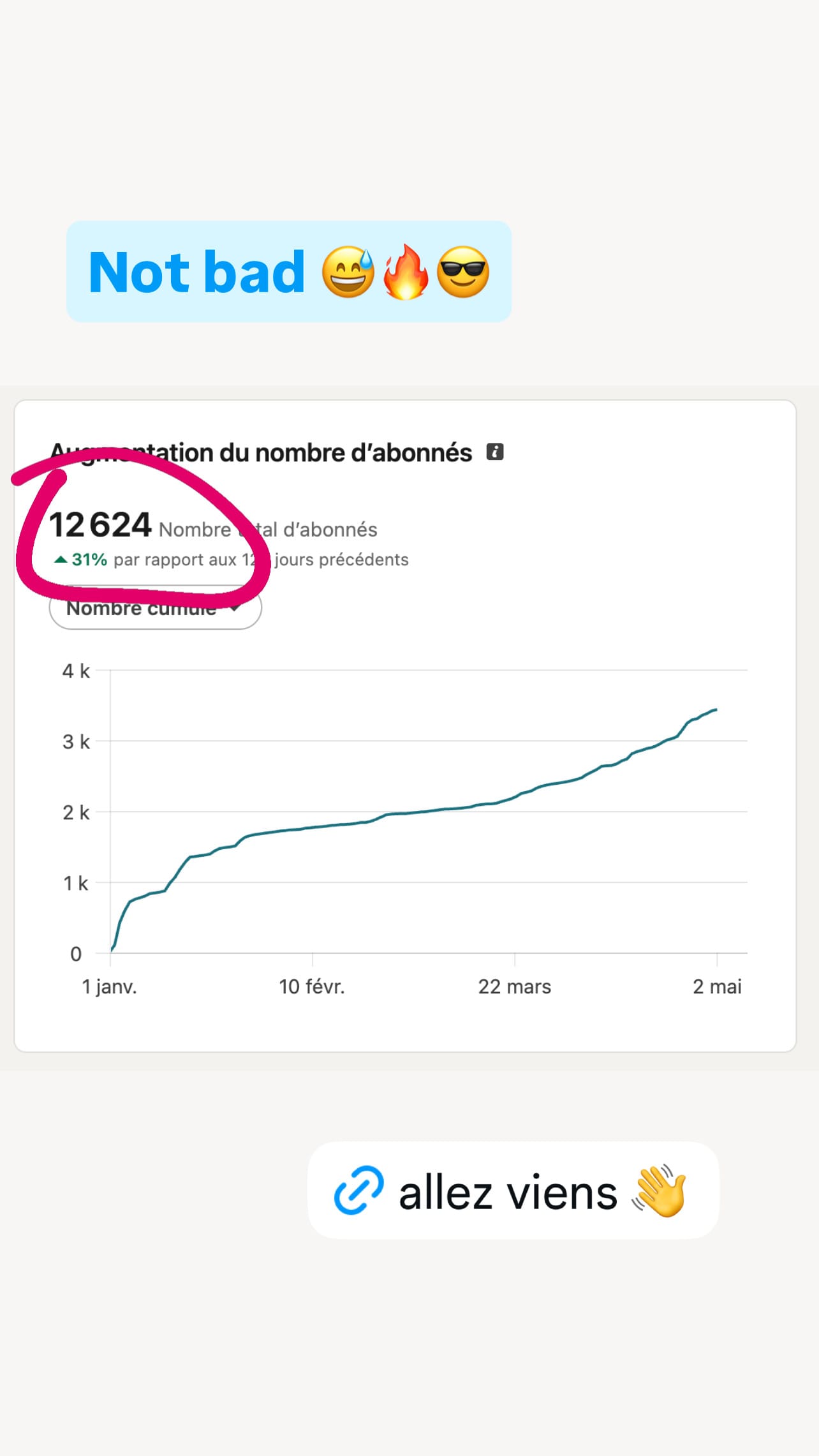

Cap symbolique cette semaine sur LinkedIn : 2 millions d'impressions cumulées et plus de 3 000 nouveaux abonnés.

Merci à toutes celles et ceux qui partagent, commentent, contredisent. C'est ce flux quotidien qui alimente ma veille hebdomadaire et qui rend possible la consolidation que tu trouves dans la section pistes d'action ci-dessus. 🙏

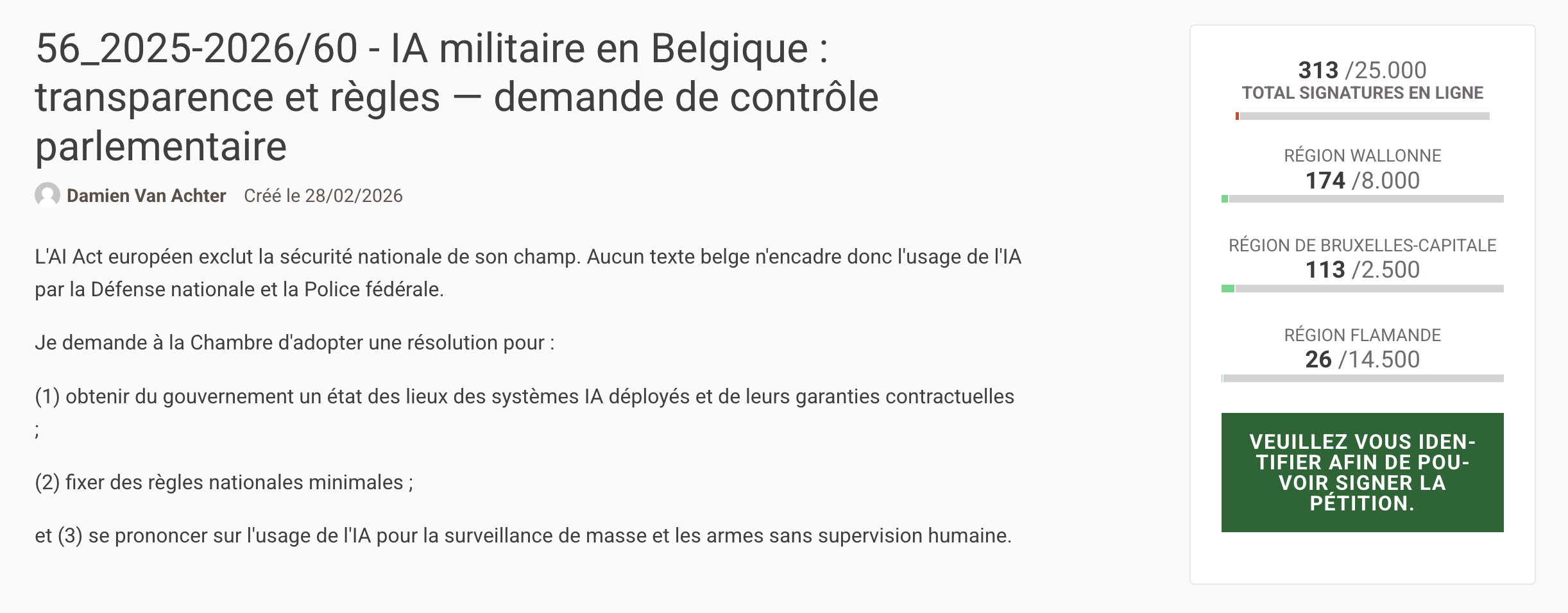

313 signatures ... and counting

Le règlement européen sur l'IA exclut explicitement la sécurité nationale de son périmètre. En Belgique, aucun cadre législatif ne régit aujourd'hui l'utilisation de l'intelligence artificielle par la Défense ou la Police fédérale. La pétition déposée à la Chambre demande trois choses concrètes : un inventaire des systèmes IA déjà déployés, des standards nationaux minimaux, et un positionnement parlementaire sur la surveillance de masse et les armes autonomes.

Comment agir ? La pétition nécessite 25 000 signatures, réparties entre la Flandre, la Wallonie et Bruxelles, pour déclencher un examen parlementaire. C'est un mécanisme démocratique existant — il suffit de l'activer. Signer prend moins d'une minute sur le site de la Chambre

💬 Tu en veux plus ? On en discute !

Tu veux recevoir le flux quotidien des articles publiés sur le site ? Suis-moi sur LinkedIn, Bluesky, Mastodon ou Facebook !

Tu as des remarques, des suggestions, ou tu veux discuter d'une idée pour avancer dans tes propres projets ? Connecte-toi et laisse-moi un commentaire ou jette un oeil directement à mon agenda.

À dimanche prochain,

Damien