Le 8 mai, Meta a supprimé le chiffrement de bout en bout des messages Instagram. Le même jour, Bruxelles adoptait un compromis qui repousse de seize mois les obligations sur l'IA à haut risque, en échange d'une interdiction des outils de génération d'images intimes non consenties. Trois jours plus tôt, le FBI avait ouvert une enquête criminelle contre Sarah Fitzpatrick, la journaliste de The Atlantic qui avait documenté l'alcoolisme et les absences répétées de Kash Patel à la tête de l'institution.

Ces trois faits ne sont pas indépendants. Ils dessinent une opération en deux temps.

Premier temps : prendre sans demander.

Google a déployé silencieusement Gemini Nano — quatre gigas — sur trois milliards de Chrome. Pas de demande. Pas de fenêtre d'accord. Le fichier weights.bin apparaît sur ton disque, et même quand tu le supprimes, il se réinstalle. Le porte-parole de Google assume publiquement : « c'est pour ton bien ».

Pendant que Chrome s'installe, des startups défuntes vendent les archives d'emails et de Slack de leurs anciens employés à des entreprises d'IA. Marché estimé à un milliard de dollars. Les chauffeurs Uber, eux, deviennent des capteurs : équipements greffés sur les véhicules pour entraîner les voitures autonomes des partenaires. Et au bureau, le bracelet Anoria et l'outil MorphCast notent ton humeur en temps réel pour le compte de ton manager.

Tu cliques sur quoi cette semaine ? La question a cessé d'être pertinente. Le consentement n'est plus la base du contrat numérique. Il est devenu cosmétique.

Deuxième temps : neutraliser ceux qui pouvaient dire non.

Trente eurodéputés ont publié une alerte cette semaine : les institutions européennes n'ont pas accès aux IA frontières — Mythos d'Anthropic en particulier — qu'elles sont supposées évaluer. Le Cybersecurity Act n'a pas prévu ce cas. Le régulateur découvre qu'il ne peut pas tester ce qu'il prétend réguler.

Au même moment, le FBI cible la journaliste plutôt que le sujet de son enquête. Le Pentagone signe avec huit géants tech un oligopole IA militaire — et écarte Anthropic du tour de table. Pékin fait annuler RightsCon en Zambie cinq jours avant l'ouverture parce qu'Access Now refuse d'exclure les participants taïwanais. Et un super PAC de cent quarante millions de dollars, lié à OpenAI et Palantir, paie des influenceurs cinq mille dollars par vidéo pour faire de la propagande IA — sans transparence sur le financement.

Les piliers de soutien des contre-pouvoirs cèdent un par un. La même semaine. Sans coordination apparente. Mais avec un effet cumulé qui ressemble à un agenda.

La respiration

Des coalitions tiennent. L'Allemagne publie le référentiel C3A — quatre-vingt-dix jours d'autonomie déconnectée comme exigence par défaut pour les opérateurs critiques, ingénieurs locaux capables de compiler sans dépendance externe. NOYB attaque LinkedIn pour avoir mis le droit d'accès RGPD derrière un paywall Premium. Un développeur allemand, Sixtus, publie le Spotify AI Blocker — quatre mille sept cents artistes IA détectés et filtrés. Les Tchèques décernent leurs Big Brother Awards. L'Australie impose 2,25 % aux plateformes qui refusent de payer les médias.

Aucune de ces ripostes n'est complète. Toutes sont fragmentaires. Mais chacune fait apparaître la même chose : prendre sans demander n'est tenable que si personne n'a les moyens de dire non. Quand quelqu'un — un dev, un État, une ONG — se donne ces moyens, la pince se desserre.

Désinstaller Gemini Nano dans Chrome se fait en quatre clics. Un geste minuscule. Multiplié par trois milliards, ça pèse.

Je m'appelle Damien Van Achter, Je suis journaliste, prof et consultant en innovation et en pédagogie entrepreneuriale. Depuis 2005, j'essaye de comprendre et de raconter comment fonctionnent nos systèmes informationnels.

Au cours du temps, j'ai développé des outils d'analyse qui repèrent les pièges tendus par les entreprises de la tech et certains états, et j'explore des pistes pour tenter de s'en libérer, positivement et avec discernement.

J'explique ici ma démarche, inspirée récemment des travaux de l'historien Timothy Snyder, comment ces analyses sont produites techniquement et humainement, ainsi que leurs limites.

On t'a transféré ce mail ? Tu peux t'abonner en 1 clic pour recevoir les suivants.

Tu as des remarques, des suggestions, ou tu veux discuter d'une idée pour avancer dans tes propres projets ? Jette un oeil à mon agenda. 📆

@davanac

🎯 À lire absolument cette semaine

🇪🇺 Bruxelles interdit les deepnudes — et offre seize mois de répit aux industriels

L'accord Omnibus signé cette semaine fait coexister deux mouvements opposés. D'un côté, l'AI Act ajoute une interdiction des outils de génération d'images intimes non consenties — une victoire pour les associations de protection, qui réclamaient une réponse européenne depuis l'explosion des deepfakes. De l'autre, le compromis repousse de seize mois les obligations encadrant l'IA à haut risque. Le calendrier coïncide avec une intense pression industrielle, et l'alignement de plusieurs partis très intéressés par les services des géants tech. Une interdiction visible, un recul invisible : la mécanique typique du double-bind réglementaire.

🤖 Chrome installe 4 Go d'IA sur ton disque sans rien te demander

Google a poussé Gemini Nano sur Chrome au cours des dernières semaines. Pas de notification, pas de réglage opt-in. Le fichier weights.bin s'auto-réinstalle même après suppression. Quand des utilisateurs ont demandé pourquoi, le porte-parole a répondu que c'était « pour leur bien » — formulation qui explicite la doctrine : ton consentement n'est plus une donnée d'entrée du système. Trois milliards d'appareils concernés. La désinstallation existe ; elle suppose que tu saches qu'elle existe.

🇩🇪 L'Allemagne fait de la défiance une doctrine technique avec C3A

Le BSI allemand vient de publier C3A, un référentiel cloud destiné aux opérateurs critiques. Au cœur du dispositif : quatre-vingt-dix jours d'autonomie déconnectée exigés par défaut, et la présence d'ingénieurs locaux capables de compiler le code sans dépendance à un fournisseur externe. C'est moins un texte réglementaire qu'une grammaire de la résilience exportable. Il rend opérationnel ce que l'Europe répète depuis cinq ans sans le traduire en obligations mesurables.

⚡ Les pistes d'action concrètes

🎯 Quick wins (ce mois-ci)

Désinstalle Gemini Nano dans Chrome Quatre clics. chrome://flags → désactiver « Optimization Guide On Device Model » → redémarrer → supprimer le dossier OptimizationGuide. Si tu administres des postes en entreprise, pousse la GPO. Geste de souveraineté individuelle, multipliable à l'échelle d'une équipe ou d'une école.

🌱 Long terme (1-2 ans)

Coalition européenne pour l'accès aux IA frontières L'alerte des trente eurodéputés ouvre une fenêtre politique. Une coalition régulateurs nationaux + chercheurs en IA + ONG numériques peut transformer cette alerte en obligation contractuelle : pas d'accès aux marchés européens sans accès des régulateurs aux modèles. Le Cybersecurity Act se révise — c'est le moment de pousser cette ligne.

Observatoire indépendant des contrats tech-militaires Alliance journalistes d'investigation + chercheurs + syndicats tech pour documenter systématiquement les accords classifiés (Pentagone–huit géants, Google–Maven, Anthropic–SpaceX). Cibler les investisseurs ESG sur les contradictions entre communication publique et pratiques contractuelles.

Le HUB des pistes d'action

Depuis le 1er janvier, j'ai publié plus de 750 pistes d'action, collectées au fil de ma veille et des articles rédigés selon le framework que j'ai développé. J'ai consolidé cette semaine le meilleur de cette dynamique de mise en action avec 30 pistes opérationnelles, organisées par profil d'acteur, mises à jour tous les trois mois pour rester collées au signal réel.

L'idée : sortir du commentaire générique. Selon ce que tu es, ce que tu décides et ce sur quoi tu peux peser, les leviers ne sont pas les mêmes.

Je te laisse les découvrir en avant-première (le hub est public, mais les fiches sont accessibles uniquement aux abonnés, donc à toi)

Si une piste te semble manquer ou si tu veux échanger sur l'application concrète à ton terrain, mon agenda est ouvert et je serai ravi d'en discuter avec toi et tes équipes.

📚 Si tu les as manqués

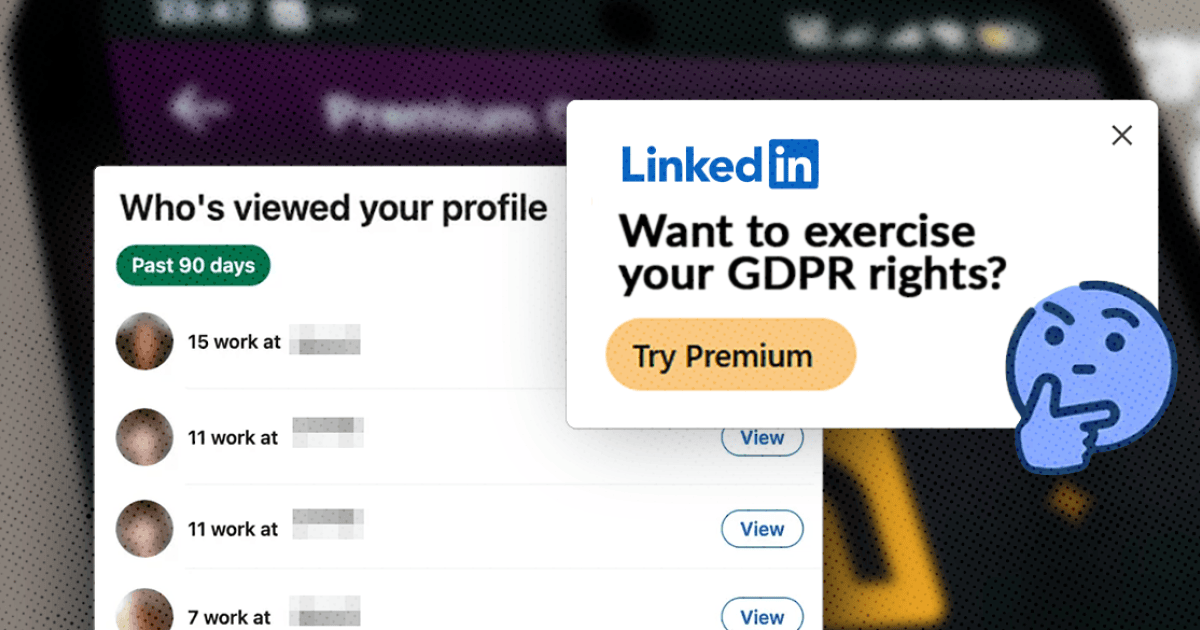

- LinkedIn met le droit d'accès RGPD derrière un paywall Premium — NOYB porte plainte. La donnée que tu pourrais demander gratuitement, LinkedIn la vend dix euros par mois.

- Meta licencie 700 annotateurs irlandais — Mission accomplie : ils ont si bien entraîné l'IA de modération qu'elle peut désormais les remplacer.

- Google revient vers l'armement, six cents employés protestent — Sept ans après l'abandon de Maven sous la pression des salariés, l'entreprise signe un contrat classifié. Le scénario recommence.

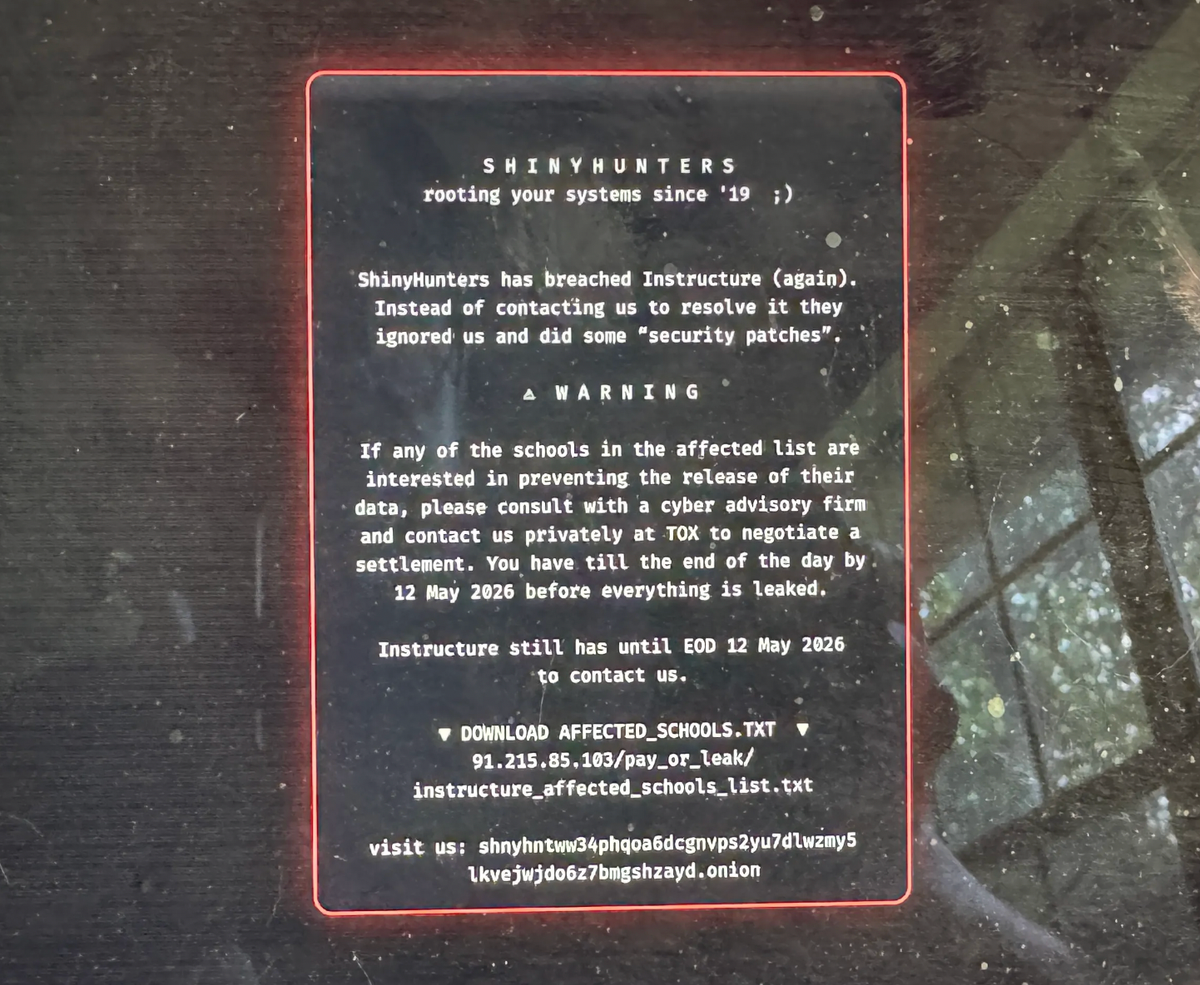

- ShinyHunters expose 275 millions d'étudiants via Canvas — La plus grande catastrophe de confidentialité étudiante de l'histoire, selon Ian Linkletter. La centralisation EdTech tient par un seul nœud.

- Login.gov passe sous contrôle DOGE — La plateforme d'identification fédérale américaine glisse vers une infrastructure de surveillance centralisée.

- 2,1 milliards de dollars envolés en arnaques sur les réseaux sociaux — Selon la FTC, les plateformes sociales sont devenues le premier canal d'escroquerie aux États-Unis en 2025, devant tous les autres.

- Amazon, Google, Meta, Microsoft achètent de la fibre noire en Irak — Pour contourner les câbles sous-marins du Golfe jugés trop vulnérables, les hyperscalers se construisent leurs propres routes terrestres le long des pipelines pétroliers.

- Les peuples autochtones redéfinissent ce qu'est une IA légitime — Une recherche australienne documente une approche relationnelle de l'IA : pas un outil neutre, mais un système qui doit servir la communauté avant l'efficacité. Cadre théorique exportable hors du contexte autochtone.

🎬 Backstage

Merci à Pascal Bustamante (RTBF) pour cet interview dans le 19h30 de Nathalie Malleux, à la base de l'article "Bruxelles interdit les deepnudes, mais s'aligne avec l'industrie et les partis (très) à droite sur l'IA à haut risque".

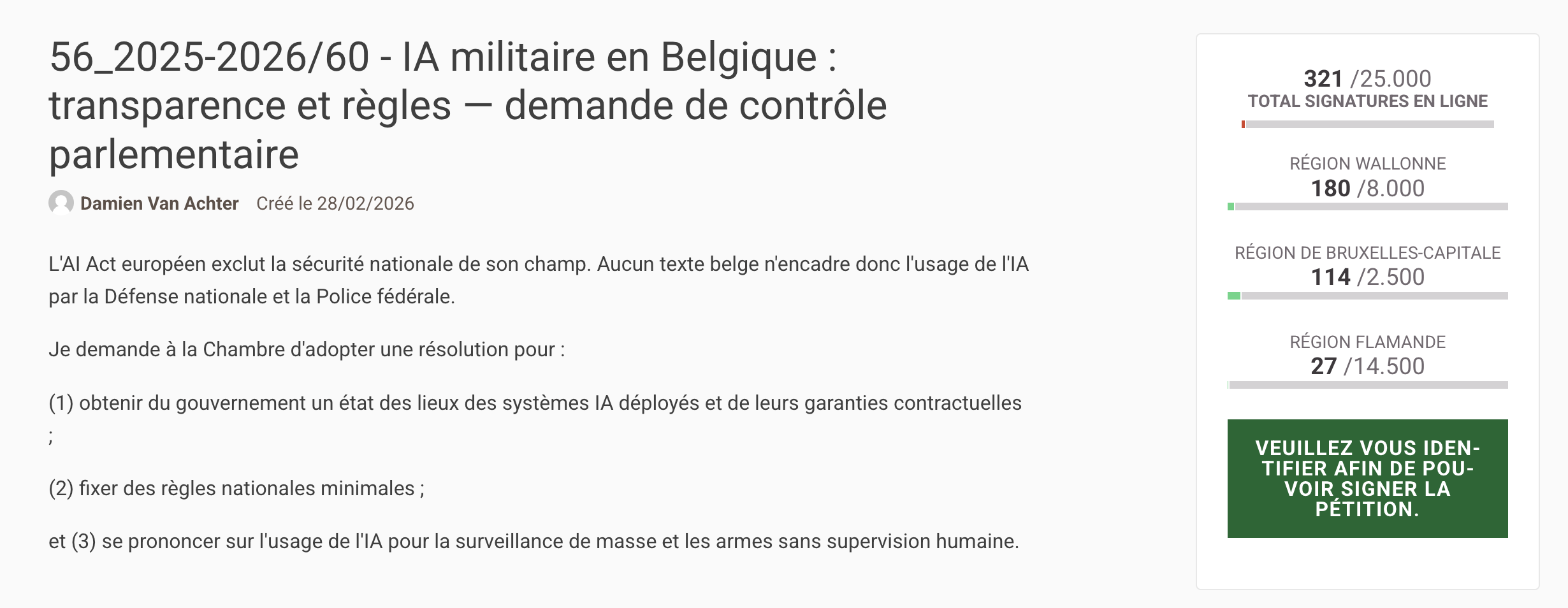

321 signatures ... and counting

Le règlement européen sur l'IA exclut explicitement la sécurité nationale de son périmètre. En Belgique, aucun cadre législatif ne régit aujourd'hui l'utilisation de l'intelligence artificielle par la Défense ou la Police fédérale. La pétition déposée à la Chambre demande trois choses concrètes : un inventaire des systèmes IA déjà déployés, des standards nationaux minimaux, et un positionnement parlementaire sur la surveillance de masse et les armes autonomes.

Comment agir ? La pétition nécessite 25 000 signatures, réparties entre la Flandre, la Wallonie et Bruxelles, pour déclencher un examen parlementaire. C'est un mécanisme démocratique existant — il suffit de l'activer. Signer prend moins d'une minute sur le site de la Chambre

💬 Tu en veux plus ? On en discute !

Tu veux recevoir le flux quotidien des articles publiés sur le site ? Suis-moi sur LinkedIn, Bluesky, Mastodon ou Facebook !

Tu as des remarques, des suggestions, ou tu veux discuter d'une idée pour avancer dans tes propres projets ? Connecte-toi et laisse-moi un commentaire ou jette un oeil directement à mon agenda.

À dimanche prochain,

Damien