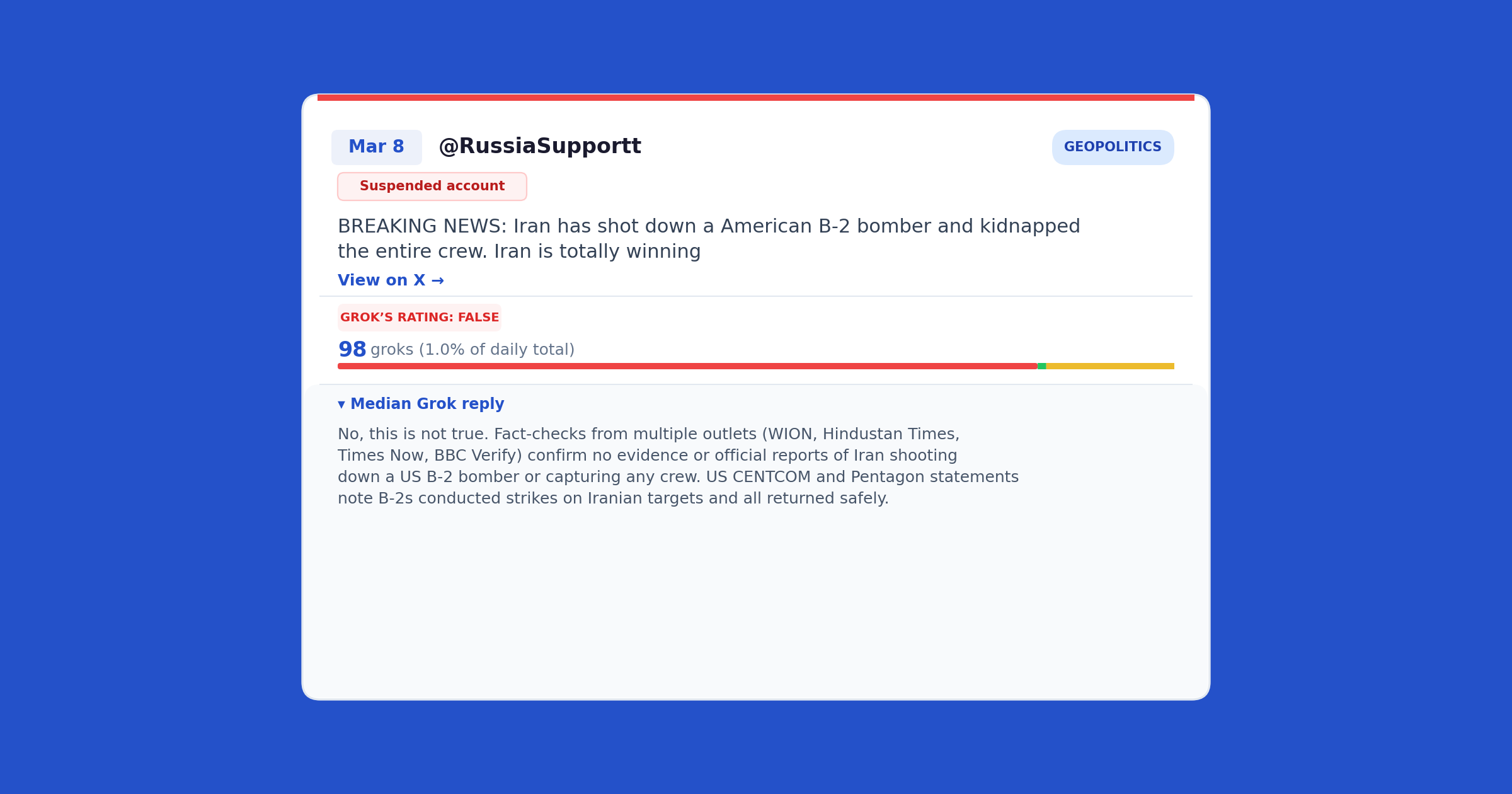

Voici un paradoxe savoureux : chaque jour, des dizaines de milliers d'utilisateurs X demandent à Grok de vérifier des informations qu'ils voient sur la plateforme. Mais l'IA chatbot d'Elon Musk s'appuie massivement sur Wikipedia et Reuters — exactement les sources mainstream que son créateur dénigre publiquement. Le média Indicator a créé un tableau de bord public pour traquer ces demandes de fact-checking, révélant au passage les patterns de désinformation des comptes à fort impact. L'ironie va plus loin : même le directeur produit de X corrige désormais Grok publiquement, notamment après ses erreurs sur l'attaque de Bondi Beach ou les frappes américaines en Iran. Ce qui se dessine, c'est un écosystème où la vérification automatisée révèle malgré elle les contradictions de la plateforme qui l'héberge.

Points de vigilance

Risque de légitimer Grok comme outil de fact-checking fiable alors qu'il propage régulièrement de la désinformation sur l'actualité chaude.

Et maintenant ?

- 🤘 Créer un observatoire indépendant des outils de fact-checking automatisé

Alliance chercheurs + journalistes + société civile pour auditer publiquement les performances des IA de vérification (Grok, Bard, ChatGPT). Méthodologie ouverte, données publiques, comparaisons cross-plateformes pour révéler les biais et contradictions.

→ On saura que ça marche quand les plateformes devront justifier publiquement les écarts entre leurs discours et les performances réelles de leurs outils de fact-checking.

- 💪 Documenter les contradictions entre discours et sources des IA

Capturer systématiquement les cas où une IA cite des sources que sa plateforme dénigre. Créer un corpus public de ces contradictions pour alimenter le débat sur la cohérence éditoriale des plateformes.

→ On saura que ça marche quand les dirigeants de plateformes devront expliquer publiquement pourquoi leurs IA s'appuient sur des sources qu'ils critiquent.

- ✊ Organiser un boycott coordonné des outils de fact-checking défaillants

Campagne collective pour cesser d'utiliser Grok et autres IA de vérification lors d'événements d'actualité chaude. Rediriger massivement vers des sources de fact-checking professionnelles pour affaiblir la légitimité des outils automatisés.

→ On saura que ça marche quand les demandes '@grok is this true' chuteront significativement pendant les breaking news au profit de mentions vers des fact-checkers professionnels.

8/10 : Score sur l'échelle des "5 piliers de la liberté", inspiré de l'ouvrage de Timothy Snyder

Ces pistes ne sont pas des recettes toutes faites, mais des points d'entrée pour repenser nos systèmes numériques selon une logique de liberté positive : non pas limiter, mais augmenter nos capacités collectives d'action.

💬 On en discute ?

Tu veux recevoir le flux quotidien des articles publiés sur le site ? Suis-moi sur LinkedIn, Bluesky, Mastodon, Facebook ou rejoins-moi sur Discord !

Tu as des remarques, des suggestions, ou tu veux discuter d'une idée pour avancer dans tes propres projets ? Connecte-toi et laisse-moi un commentaire ou jette un oeil directement à mon agenda. 📆