L'intelligence artificielle ne crée pas de nouveaux problèmes : elle révèle et amplifie exponentiellement les failles déjà présentes dans nos systèmes de production, vérification et diffusion de l'information.

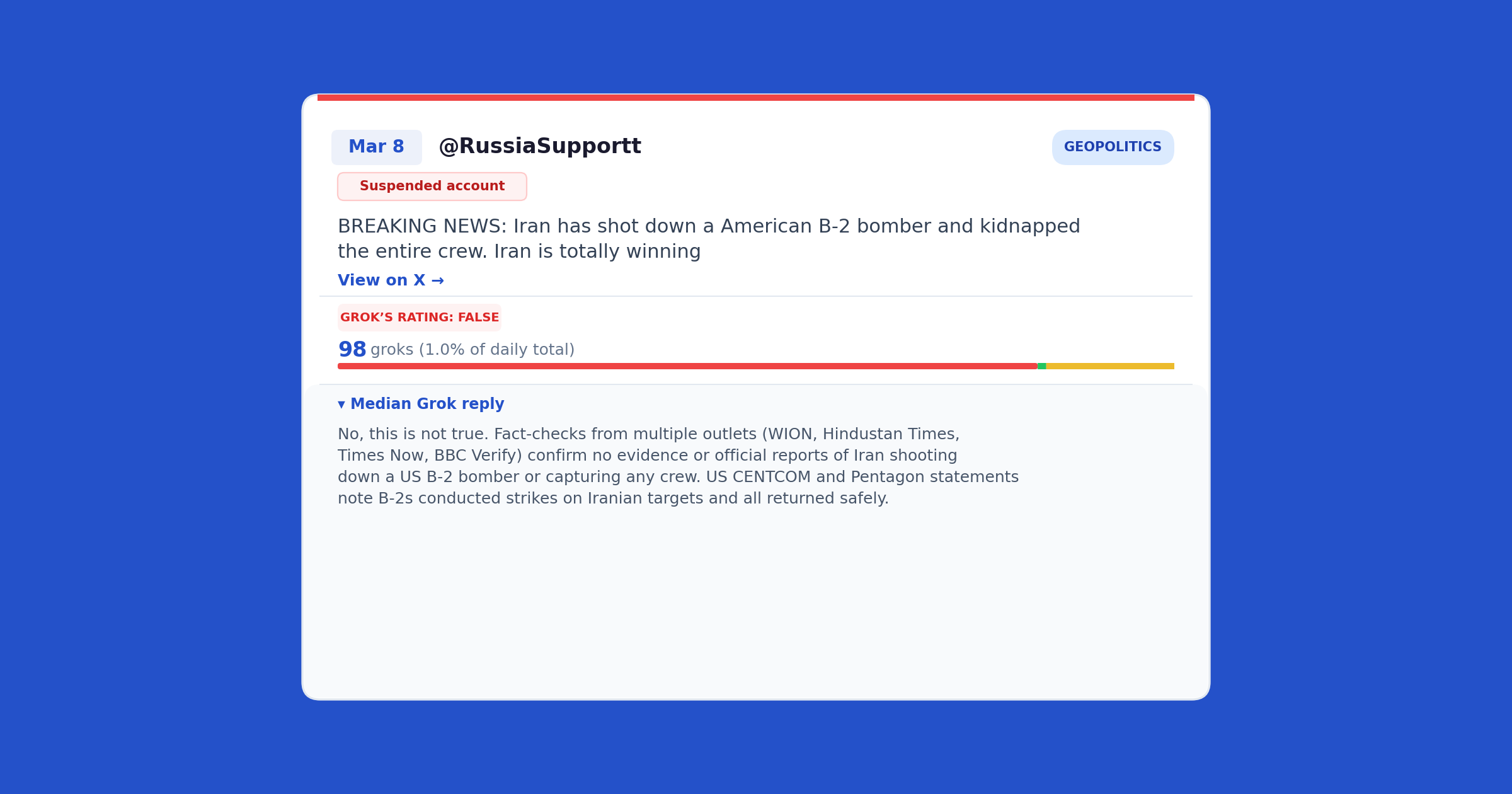

Un pattern systémique émerge de ces sept situations : l'IA fonctionne comme un révélateur chimique qui expose les fractures de notre écosystème informationnel. L'expertise humaine critique s'évapore précisément quand elle devient cruciale pour corriger les outputs algorithmiques. Les données militaires obsolètes tuent 175 enfants parce que l'automatisation perpétue les erreurs humaines à l'échelle industrielle. Grok s'appuie sur Reuters et Wikipedia tout en servant une plateforme qui dénigre ces sources. OpenAI détecte des signaux d'alarme mais choisit l'inaction, créant un précédent juridique sur la responsabilité des entreprises d'IA.

Cette asymétrie se retrouve partout : la cybercriminalité progresse de 89% par an grâce à l'IA générative, les algorithmes de X fabriquent des préférences politiques d'extrême droite, et 560 demandes de financement révèlent que le journalisme local s'effondre faute d'infrastructures partagées. Dans chaque cas, l'IA amplifie des défaillances préexistantes : formation insuffisante des experts, maintenance défaillante des bases de données, hypocrisie des plateformes, déresponsabilisation des entreprises tech, asymétrie entre attaque et défense, manipulation algorithmique, sous-financement chronique des médias.

Le paradoxe ultime : plus l'IA devient performante, plus elle révèle notre dépendance à des systèmes de vérification humains qui s'effritent. L'expertise critique du rejet devient l'or noir de l'ère IA, mais personne ne la capitalise. Les plateformes détectent les signaux d'alarme mais ne les traitent pas. Les algorithmes citent des sources qu'ils délégitiment. Cette contradiction systémique crée une crise de la factualité où la technologie censée nous aider à distinguer le vrai du faux devient elle-même un vecteur de confusion.

Ce qui se joue ici dépasse les dysfonctionnements techniques : c'est l'effondrement de notre capacité collective à maintenir une réalité commune. Quand l'expertise s'évapore, les données restent obsolètes, les sources sont délégitimées par ceux qui s'en servent, les entreprises évitent leurs responsabilités, les criminels industrialisent leurs attaques, les algorithmes fabriquent l'opinion et les médias locaux disparaissent, il ne reste plus d'infrastructure fiable pour distinguer le factuel du plausible.

Points de vigilance : Risque de sur-surveillance préventive au nom de la sécurité. Les solutions techniques peuvent créer de nouveaux oligopoles ou points de vulnérabilité centralisés. Attention à ne pas créer une nouvelle forme de gatekeeping technologique qui exclut les profils émergents. La consolidation peut standardiser excessivement le journalisme local selon les priorités des financeurs plutôt que des communautés.

9/10 : Score sur l'échelle des "5 piliers de la liberté", inspiré de l'ouvrage de Timothy Snyder

https://da.van.ac/note-methodologique-5-piliers/

Et maintenant ?

Le croisement de ces sources fait apparaître des pistes d'action que chaque article seul ne révélait pas.

🤘 Créer un consortium européen de capitalisation de l'expertise critique IA

Alliance secteurs publics + universités + entreprises pour mutualiser et structurer l'expertise de correction IA. Chaque rejet documenté enrichit une base commune européenne, créant un avantage concurrentiel collectif face aux pure-players IA américains et chinois. Financement par taxe sur les revenus IA des GAFAM en Europe.

→ On saura que ça marche quand l'Europe exportera ses standards de 'rejection patterns' vers d'autres continents plutôt que d'importer les modèles américains

🤘 Organiser un front commun médias-régulateurs contre l'opacité algorithmique

Coalition médias locaux + fact-checkers + régulateurs pour imposer la transparence des algorithmes de recommandation en période électorale. Les médias apportent la légitimité, les régulateurs le pouvoir de sanction, ensemble ils créent un rapport de force inédit contre les plateformes.

→ On saura que ça marche quand les plateformes négocieront des accords-cadres de transparence avec des coalitions médias-régulateurs plutôt que de subir des sanctions individuelles

✊ Lancer un boycott coordonné des outils d'IA non-auditables en période sensible

Campagne collective pour cesser d'utiliser Grok, ChatGPT et autres IA de vérification lors d'événements d'actualité chaude ou de campagnes électorales. Rediriger massivement vers des sources de fact-checking professionnelles pour affaiblir la légitimité des outils automatisés non-transparents.

→ On saura que ça marche quand les demandes de fact-checking IA chuteront de 50% pendant les breaking news au profit de mentions vers des fact-checkers professionnels

"OpenAI avait une connaissance spécifique du tireur utilisant ChatGPT pour planifier un événement de masse comme la fusillade de Tumbler Ridge [traduit de l'anglais]"

"Huit des dix comptes politiques français les plus visibles appartiennent à l'extrême droite ou à la gauche radicale indépendamment de leur communauté"

"Le financement philanthropique peut involontairement stabiliser un équilibre fragile. Les organisations restent vivantes mais sous-financées, dépendantes de subventions récurrentes pour maintenir les opérations de base, et incapables d'accumuler la capacité requise pour la résilience à long terme."

Ces pistes ne sont pas des recettes toutes faites, mais des points d'entrée pour repenser nos systèmes numériques selon une logique de liberté positive : non pas limiter, mais augmenter nos capacités collectives d'action.

On en discute ?

Tu veux recevoir le flux quotidien des articles publiés sur le site ? Suis-moi sur LinkedIn, Bluesky, Mastodon, Facebook ou rejoins-moi sur Discord !

Tu as des remarques, des suggestions, ou tu veux discuter d'une idée pour avancer dans tes propres projets ? Connecte-toi et laisse-moi un commentaire ou jette un oeil directement à mon agenda.