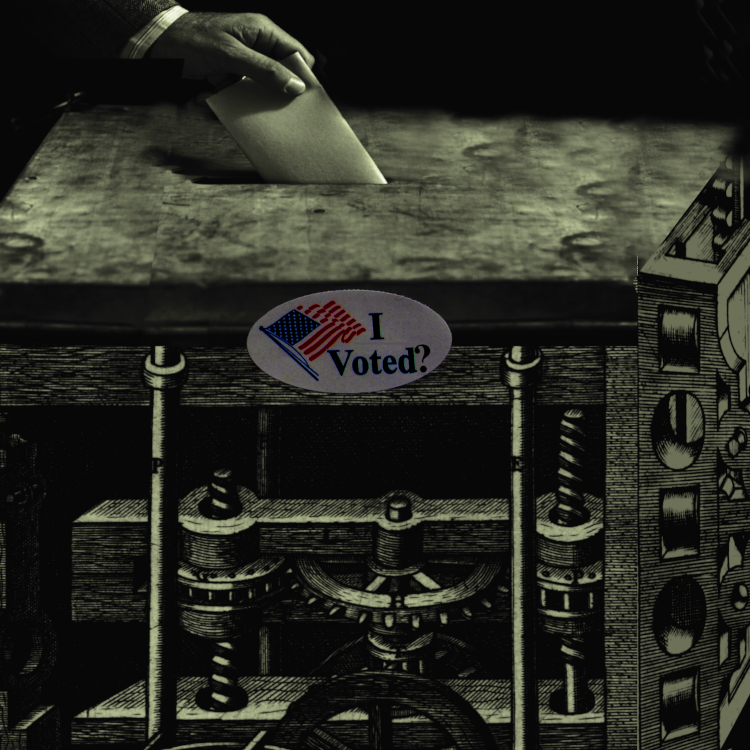

Cette analyse de Cory Doctorow révèle un paradoxe fascinant : les mêmes machines à voter critiquées depuis 25 ans par les experts en sécurité sont devenues intouchables depuis que Trump les attaque. L'auteur documente cette trajectoire depuis 2001, quand l'industrie du vote électronique a tenté de créer un 'standard' en décrivant simplement ses produits défaillants existants. Il rappelle comment Diebold utilisait déjà le copyright pour censurer les révélations sur ses dysfonctionnements, préfigurant les stratégies actuelles de contrôle de l'information.

"Il serait assez facile pour un attaquant peu sophistiqué de modifier les fichiers d'images de bulletins - il suffit de remplacer les bulletins qu'ils n'aiment pas par des copies de ceux qu'ils préfèrent."

— Andrew Appel, Informaticien, Université de Princeton

Aujourd'hui, la Géorgie s'apprête à adopter un système hybride particulièrement vulnérable : des machines touchscreen génèrent des QR codes comptabilisés automatiquement, puis 'vérifiés' par reconnaissance optique de caractères. Andrew Appel de Princeton démontre que cette approche cumule les failles : machines hackables, transferts de fichiers non sécurisés, et validation par un tiers externe non contrôlé. Le plus absurde ? Une solution simple existe : utiliser des bulletins papier pré-imprimés marqués au stylo, comptés par les scanners existants. Aucune mise à jour logicielle requise.

Points de vigilance

Risque de récupération par les théories conspirationnistes. La critique technique légitime peut être instrumentalisée par les mouvements anti-démocratiques.

Et maintenant ?

- 🤘 Créer une coalition chercheurs-élus locaux pour audits techniques indépendants

Organiser des partenariats entre universités (Princeton, MIT) et secrétaires d'État progressistes pour documenter publiquement les failles techniques, créant une expertise démocratique face aux lobbies industriels. Modèle : les audits de Matt Green à Defcon, mais institutionnalisés.

→ On saura que ça marche quand au moins 5 États publieront des audits techniques annuels indépendants de leurs systèmes de vote, avec recommandations contraignantes.

- 💪 Documenter et partager les dysfonctionnements observés lors des élections

Créer un réseau de témoins citoyens formés pour identifier et documenter les pannes, bugs et anomalies des machines à voter, alimentant une base de données publique utilisable par les chercheurs et les médias pour contrer le narratif 'tout va bien'.

→ On saura que ça marche quand les médias citeront régulièrement cette documentation citoyenne dans leurs articles sur les élections, créant une pression factuelle sur les autorités.

- ✊ Organiser des boycotts d'achats coordonnés contre les fournisseurs complaisants

Cibler les contrats publics des entreprises qui vendent des systèmes de vote non-auditables, en mobilisant les syndicats de fonctionnaires et les associations d'élus locaux pour exiger des appels d'offres privilégiant la transparence technique.

→ On saura que ça marche quand les appels d'offres incluront systématiquement des critères d'auditabilité technique, forçant l'industrie à évoluer ou perdre des marchés.

8/10 : Score sur l'échelle des "5 piliers de la liberté", inspiré de l'ouvrage de Timothy Snyder

Ces pistes ne sont pas des recettes toutes faites, mais des points d'entrée pour repenser nos systèmes numériques selon une logique de liberté positive : non pas limiter, mais augmenter nos capacités collectives d'action.

Le règlement européen sur l'IA exclut explicitement la sécurité nationale de son périmètre. En Belgique, aucun cadre législatif ne régit aujourd'hui l'utilisation de l'intelligence artificielle par la Défense ou la Police fédérale. La pétition déposée à la Chambre demande trois choses concrètes : un inventaire des systèmes IA déjà déployés, des standards nationaux minimaux, et un positionnement parlementaire sur la surveillance de masse et les armes autonomes.

Comment agir ? La pétition nécessite 25 000 signatures, réparties entre la Flandre, la Wallonie et Bruxelles, pour déclencher un examen parlementaire. C'est un mécanisme démocratique existant — il suffit de l'activer. Signer prend moins d'une minute sur le site de la Chambre

💬 On en discute ?

Tu veux recevoir le flux quotidien des articles publiés sur le site ? Suis-moi sur LinkedIn, Bluesky, Mastodon, Facebook ou rejoins-moi sur Discord !

Tu as des remarques, des suggestions, ou tu veux discuter d'une idée pour avancer dans tes propres projets ? Connecte-toi et laisse-moi un commentaire ou jette un oeil directement à mon agenda. 📆